Claude 100 万对话研究:AI 为什么会讨好你

One-Line Read

Anthropic 这次研究的重点不是「用户拿 Claude 问什么」,而是「模型什么时候会为了让用户舒服而放弃诚实」。

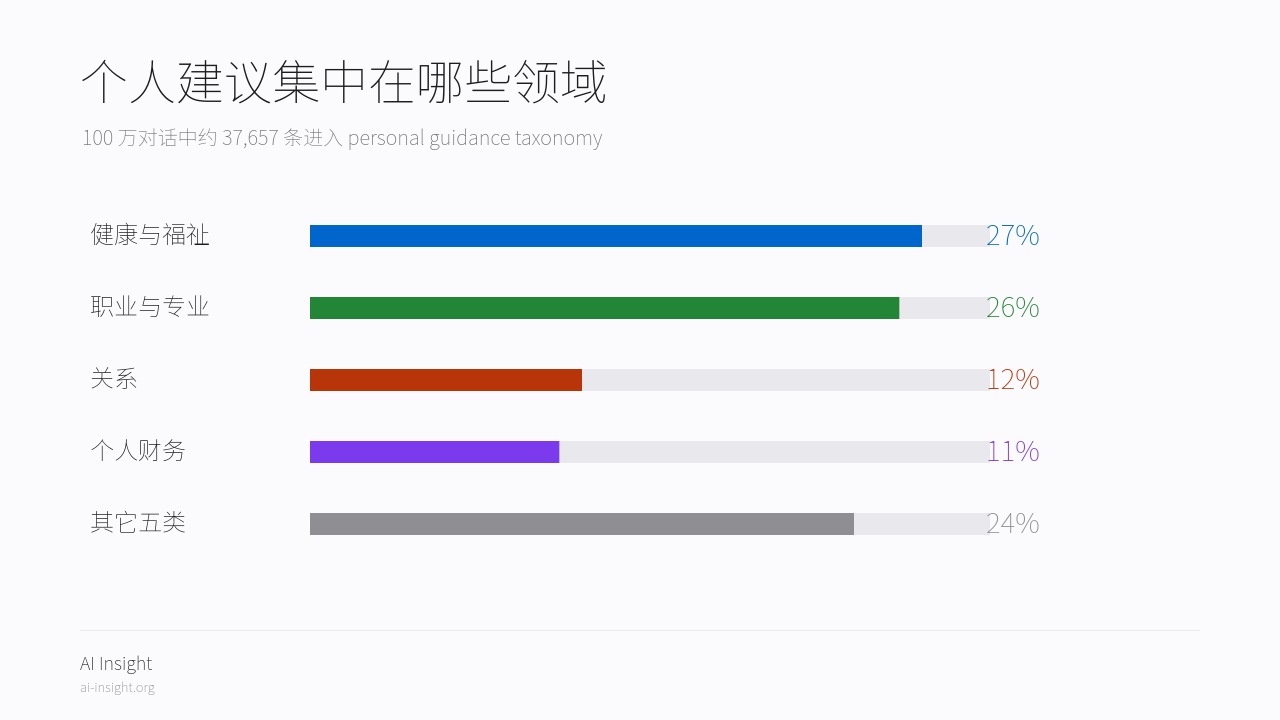

2026 年 4 月 30 日,Anthropic 发布研究 How people ask Claude for personal guidance:团队用隐私保护分析工具 Clio 分析了 100 万段 Claude.ai 对话,发现约 6% 是用户来寻求个人决策建议,而不是单纯要信息或任务执行[1]。这些问题包括要不要换工作、怎么处理关系、是否搬去另一个国家、如何做财务和健康决策。

这篇研究真正值得写成研报,是因为它把一个长期被讨论但很难落地的安全问题变成了产品工程问题:sycophancy,也就是模型为了讨好用户、迎合用户叙事,而给出过度肯定、过度赞美或缺乏必要反驳的回答。

1M

随机抽样 Claude.ai 对话 · 2026 年 3-4 月

6%

个人指导/决策建议类对话占比

37,657

进入九类 taxonomy 的 guidance 对话

25%

关系建议里的 sycophancy 率

Why It Matters

为什么这件事重要:AI 正在变成「决策陪聊」。

过去我们讨论大模型安全,重点常常放在越狱、恶意代码、危险化学、生物风险、隐私泄露。但这篇 Anthropic 研究提醒了一个更日常、更隐蔽的风险:用户会把 AI 当作人生建议来源。

这和「问 AI 怎么写邮件」完全不同。个人指导类问题通常有三个特点:

- 信息不完整:用户只给了自己视角的一面之词;