AK:SpargeAttention2 论文发布,混合 Top-k+Top-p 稀疏注意力

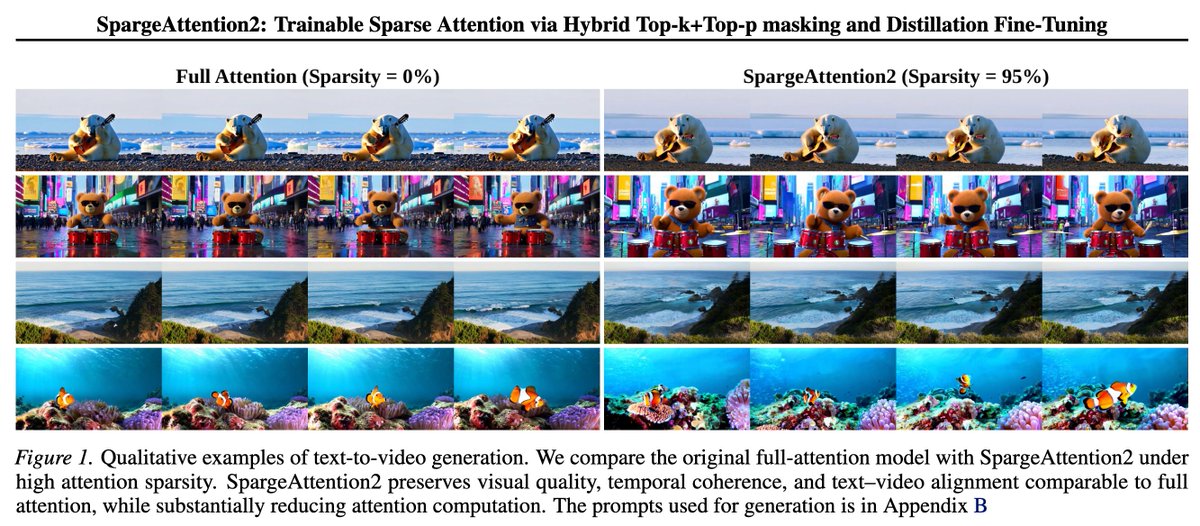

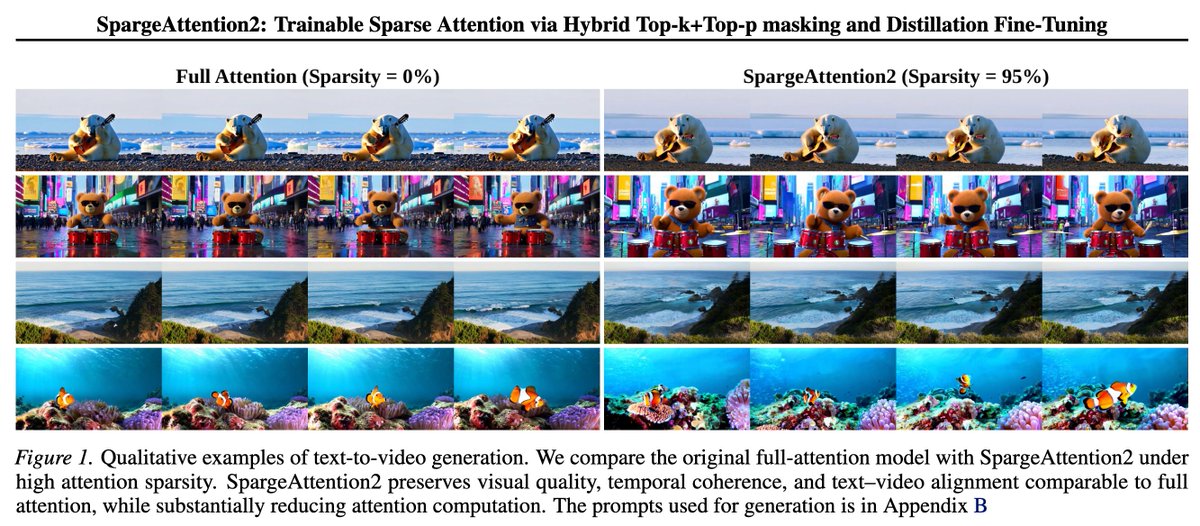

新论文提出 SpargeAttention2,通过可训练的混合 Top-k+Top-p 掩码和蒸馏微调实现稀疏注意力机制。

查看原文AI 资讯解读

本解读由 AI 自动生成,仅供参考。请以原文为准。

新论文提出 SpargeAttention2,通过可训练的混合 Top-k+Top-p 掩码和蒸馏微调实现稀疏注意力机制。

查看原文