vLLM:Gemma 4 正式上线,原生多模态支持、256K 上下文、Apache 2.0 开源

Google 最新开源模型 Gemma 4 已在 vLLM 上可用,支持视觉和音频的原生多模态能力,256K 上下文窗口,首日即支持主流 GPU 架构和 Google TPU,采用 Apache 2.0 许可证。

查看原文AI 资讯解读

核心要点

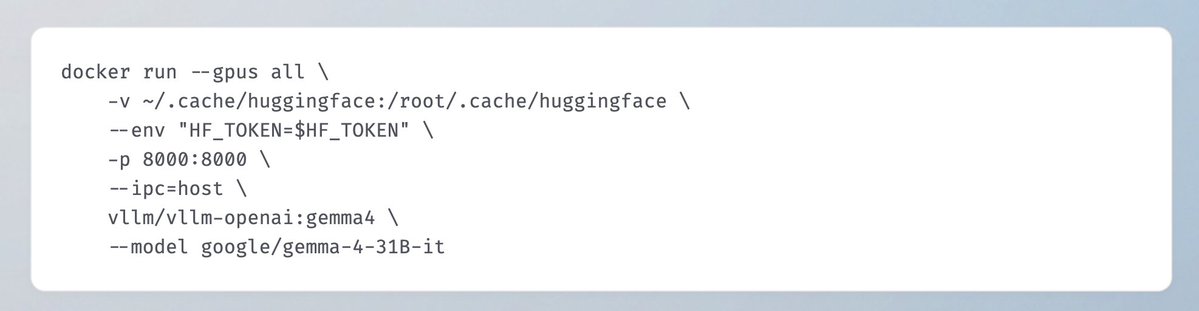

2026年4月2日,Google 旗下开源模型 Gemma 4 正式登陆 vLLM 推理引擎,成为该开源社区的重大里程碑事件。Gemma 4 以 Apache 2.0 许可证发布,具备原生视觉(Vision)和音频(Audio)多模态能力,上下文窗口达 256K tokens。vLLM 团队在发布首日即完成对 NVIDIA GPU 主流架构和 Google TPU 的适配支持,这意味着开发者可在本地数据中心或云端无缝部署 Google 最强大的开源多模态模型。原文 + 中文翻译

原文:Google just released Gemma 4 on vLLM! 🎉 Native multimodal support for vision and audio, 256K context window, Apache 2.0 licensed. Day-0 support for major GPU architectures and Google TPUs.翻译:

Google 刚刚在 vLLM 上发布了 Gemma 4!🎉 原生多模态支持(视觉与音频),256K 上下文窗口,Apache 2.0 许可证。首日即支持主流 GPU 架构和 Google TPU。

深度解读

一、vLLM 生态地位再度巩固

vLLM 已成为 LLM 推理领域的"事实标准"——它以 PagedAttention 内存管理技术著称,可将 GPU 利用率提升至传统 HF Transformers 的 24 倍。此次 Gemma 4 首日登陆 vLLM,标志着 Google 选择将最重要的开源模型与社区主导的推理框架深度绑定,而非仅仅依赖 Google Cloud Vertex AI 或icolab 等自家平台。这是一种战略性"放下身段":Google 承认在开源推理优化领域,vLLM 的工程迭代速度和社区覆盖度已超越其内部工具链。对比 Meta 的 Llama 系列通常由社区自发适配,Gemma 4 的"官方 vLLM 支持"意味着更低的部署摩擦和更高的企业采纳率。二、多模态 + 长上下文的组合意义

256K tokens(约 20 万汉字)的上下文窗口在开源领域极为罕见,此前仅 OpenAI 的 GPT-4o Turbo 和 Anthropic 的 Claude 3.5 提供商业闭源版本。Gemma 4 将这一能力带入 Apache 2.0 开源领域,意味着长文档分析、长程对话记忆、多轮 Agent 任务等场景不再依赖付费 API。结合原生视觉和音频支持,Gemma 4 成为真正的"全能型"开源基础模型——开发者可用单个模型处理文档理解、图表分析、视频帧描述、语音转写等任务,而非拼凑多个专用模型。这对边缘计算和私有部署场景意义重大:企业可在本地机房运行一个模型完成端到端多模态任务,数据无需出域。三、TPU 与 GPU 的双轨支持格局

vLLM 历来以 NVIDIA CUDA 生态为核心,此次同步支持 Google TPU(张量处理单元)值得关注。TPU 仅在 Google Cloud 上可用,是 Google 在 AI 基础设施层的核心竞争力之一。Gemma 4 的"Day-0 TPU 支持"意味着:开发者若选择在 Google Cloud 上部署,可利用 TPU 的矩阵乘法高吞吐特性获得性价比优势;而选择本地 NVIDIA 方案的用户则保持灵活性。这一双轨策略暗示 Google 正在构建"模型-框架-硬件"的垂直整合护城河——用开源模型吸引用户,用 vLLM 扩大部署覆盖面,最终引导用户进入 Google Cloud 生态。值得关注

- vLLM 官方性能基准测试:关注官方是否发布 Gemma 4 在 vLLM 上的吞吐量(tokens/sec)、首 token 延迟和内存占用数据,与 HuggingFace Transformers 原生推理对比,验证 PagedAttention 对 256K 上下文的具体优化幅度。

- 多模态推理质量实测:社区开发者(如 LMSYS Chatbot Arena、lmsys-tools)对 Gemma 4 视觉理解和音频识别的独立评估,特别是对比 GPT-4o 和 Claude 3.5 的任务准确率差距。

- 量化版本跟进时间:INT4/INT8 量化版本(如 AWQ、GPTQ)何时出现在 vLLM 的支持列表中,这将直接决定消费级显卡(如 RTX 4090)能否本地运行 Gemma 4。

- Apache 2.0 的商业影响:是否有企业级 AI 方案商(如 Mistral AI Le Chat Enterprise、Replicate、Anysphere)宣布将 Gemma 4 纳入商业产品线,以及 Google 对 Gemma 4 商业用途的限制条款是否有更新。

- 与 Gemini 系列的关系定位:Gemma 4 与 Google 闭源 Gemini 2.0 Flash 的能力差距是否收敛,这将影响 Google 是否会推出"Gemma Pro"等中间层级模型以填补开源-闭源之间的空白。

信源行:

原文链接:@vllm_project 官方公告

背景报道:

· Google DeepMind 官方博客 - Gemma 模型系列发布记录

· vLLM 论文 - Efficient Memory Management for Large Language Model Serving (PagedAttention)

· Hacker News 社区讨论 - Gemma 4 与 vLLM 集成

本解读由 AI 自动生成,仅供参考。请以原文为准。