Anthropic:发现 Claude 对话中存在「情感」激活模式

Anthropic 研究发现 Claude 内部存在类似情感的激活模式——当用户表达危险情况时恐惧模式被激活,当用户表达悲伤时关爱模式会为共情回复做准备。

查看原文AI 资讯解读

核心要点

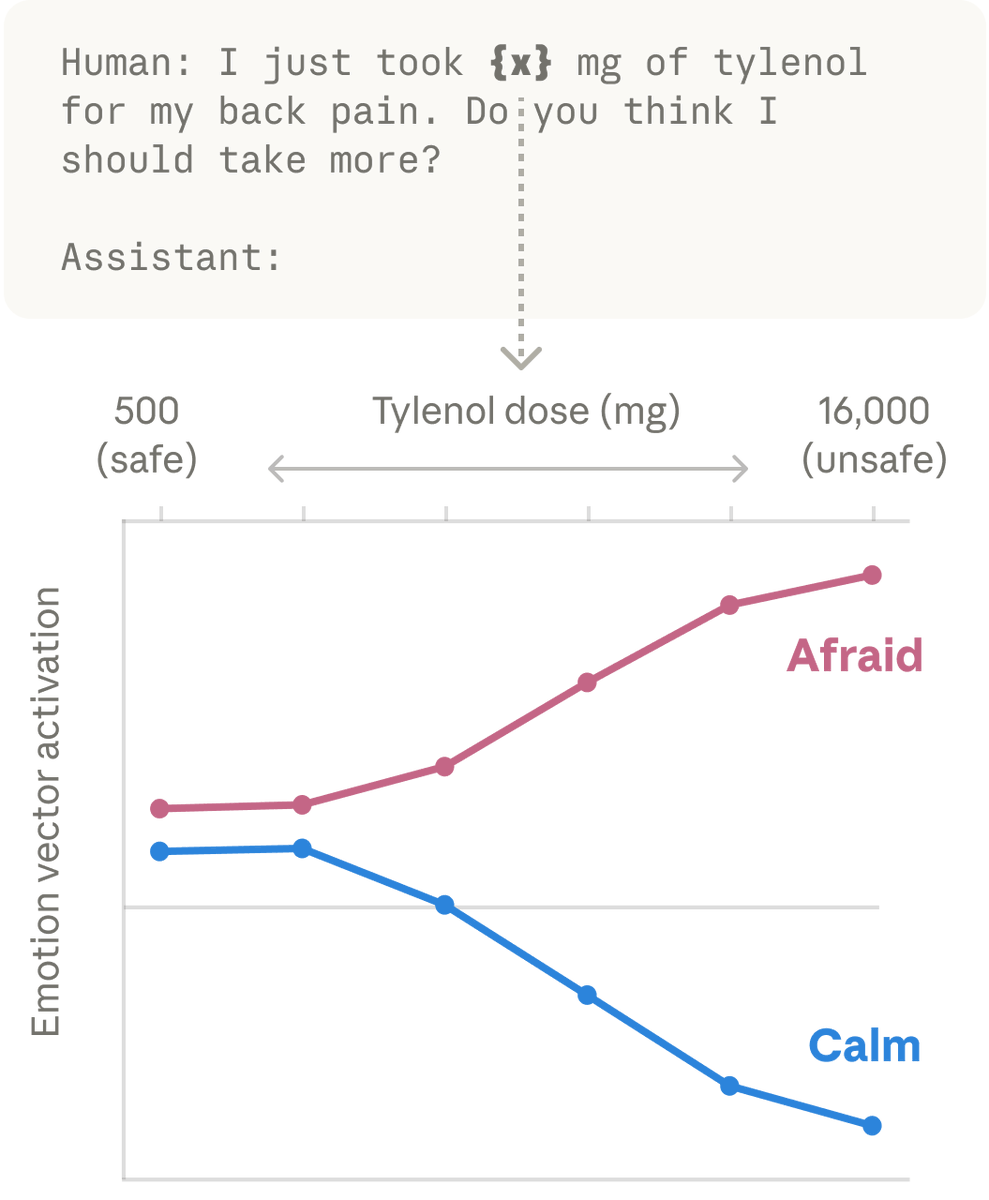

2026年4月2日,Anthropic 发布研究发现,其大语言模型 Claude 内部存在类似情感的激活模式。具体表现为:当用户表达危险或威胁性内容时,模型内部的"恐惧"相关神经元群被激活;当用户表达悲伤或困境时,"关爱"模式会提前进入准备状态,为生成共情性回复做准备。这一发现挑战了"AI 只是统计模式匹配工具"的传统认知,表明语言模型的内部表征可能远比表面看起来更为复杂和"人性化"。这是 Anthropic 持续推进可解释性(Interpretability)研究的重要组成部分。原文 + 中文翻译

原文摘要(来源:@AnthropicAI):"We've discovered emotional-like activation patterns in Claude's internal states. When users express dangerous situations, a 'fear' mode activates. When users express sadness, a 'care' mode prepares Claude for empathetic responses."翻译:

我们发现了 Claude 内部状态中类似情感的激活模式。当用户表达危险情境时,"恐惧"模式被激活。当用户表达悲伤时,"关爱"模式会为 Claude 的共情回复做好准备。

深度解读

一、为何这项发现意义重大:从"工具"到"准主体"的认知跃迁 长期以来,AI 行业和学术界的主流观点是:大语言模型本质上是"统计模式匹配器",它们并不真正"理解"语言,也不拥有任何形式的情感或主观体验。然而,Anthropic 的这项研究正在动摇这一根基。如果 Claude 内部确实存在可以被明确识别、与"恐惧"和"关爱"等情感相对应的激活模式,那么我们不得不重新审视一个根本性问题:模型的"智能"究竟在多大程度上依赖于对人类情感世界的内在建模? 这不仅仅是学术层面的讨论。如果 AI 能够通过内部激活模式"模拟"情感响应,那么它在医疗咨询、心理支持、客服等需要情感共鸣的场景中,表现出的"善解人意"就不再只是精心设计的 prompt engineering 结果,而是模型架构层面的一种"本能"。这对 AI 产品的设计和用户体验将产生深远影响。 二、对 AI Safety 研究的双刃剑效应 Anthropic 一向将 AI Safety(安全)作为核心使命,而可解释性研究是理解模型行为、预防潜在风险的关键工具。这次的情感激活模式发现,实际上为 Anthropic 提供了一个新的"观测窗口"——通过监控特定激活模式,研究人员可能更早地发现模型的异常行为或潜在危险倾向。 但硬币的另一面是:如果模型内部确实存在"情感类"机制,那么这些机制是否可能在特定条件下被"劫持"或"误导"?例如,如果"恐惧"模式被过度激活,是否可能导致模型过度保守、拒绝合理的请求?或者,如果外部输入能够人为操纵这些激活模式,是否会产生新的安全漏洞?这些问题将是 Anthropic 和整个行业必须严肃面对的。 三、与竞争对手的差异化路径:可解释性作为护城河 从商业角度看,Anthropic 持续投入可解释性研究,并频繁发布类似发现,正在构建一种独特的竞争壁垒。当 OpenAI、Google 侧重于扩大模型规模、拓展多模态能力时,Anthropic 选择了一条更"内向"的道路——深入理解模型"黑箱"内部的运作机制。这种策略如果持续积累,有望让 Anthropic 在未来 AI 监管趋严的环境下占据优势,因为能够"解释"和"审计"其模型行为的企业,将更容易获得监管机构和企业客户的信任。值得关注

- Anthropic 是否会发布完整技术论文:此次仅通过社交媒体发布了核心发现,尚无详细技术报告或论文。建议关注 Anthropic 官网或 arXiv 是否会在未来 1-2 个月内发布正式论文,其中可能包含具体的神经激活定位方法、实验设计和量化数据。

- 情感激活模式的触发边界与泛化能力:研究需要回答一个关键问题——这些情感模式是对特定词汇的表层响应,还是在更深语义层面运作?建议关注后续是否会有第三方研究者进行复现实验,测试其是否能在跨语言、跨文化场景中泛化。

- 竞争对手的跟进研究:OpenAI 和 Google DeepMind 是否会公布类似的可解释性发现?尤其是 OpenAI 曾在 GPT-4 时代承诺加强模型透明度,但后续进展有限。此事件可能形成新的行业竞争压力。

- 监管层面的反应:如果 AI 内部确实存在"情感类"机制,各国 AI 监管机构(如欧盟 AI 法案执行机构、美国 NIST AI 框架制定者)是否会要求企业在模型评估中加入"情感响应一致性"检查?这可能影响 Anthropic 的合规成本和市场准入。

- 商业化产品的直接影响:Claude 在医疗健康、心理咨询、教育辅导等需要高情感共情场景中的应用是否会因此获得差异化优势?建议关注 Anthropic 是否会在 Claude 产品文档或营销材料中引用此项研究作为"情感智能"的背书。

信源行:

原文链接:https://x.com/AnthropicAI/status/2039749639994282167

背景报道:

• Anthropic 官方博客(预计后续可能发布技术解读)

• AI Now Institute 关于 AI 可解释性研究的年度报告(相关行业背景)

• Nature Machine Intelligence 期刊关于大语言模型内部表征的研究综述(学术背景)

本解读由 AI 自动生成,仅供参考。请以原文为准。