Cursor:在 Blackwell GPU 上重建 MoE 推理引擎,速度提升 1.84 倍

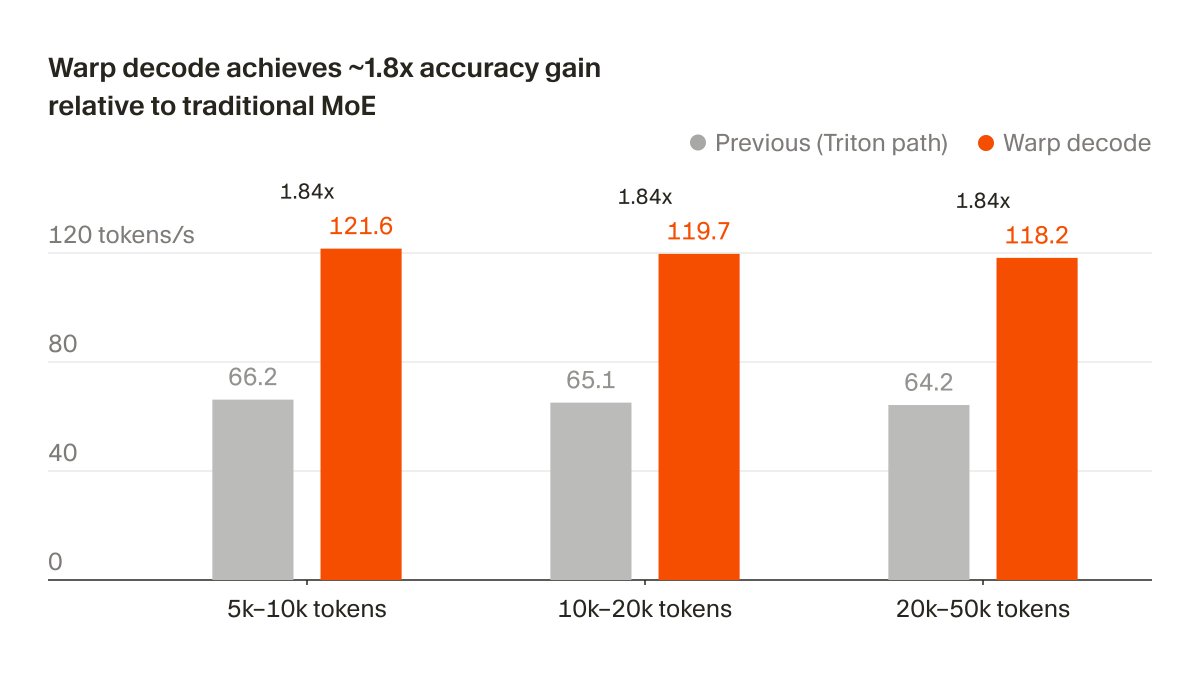

Cursor 团队重新设计了 MoE 模型在 Blackwell GPU 上的 token 生成方式,推理速度提升 1.84 倍且输出更精准。这些改进直接服务于 Composer 模型的训练迭代。

查看原文核心要点

2026 年 4 月 6 日,Cursor 官方账号 (@cursor_ai) 披露团队已在 NVIDIA Blackwell 架构 GPU 上完成了 MoE(Mixture of Experts,混合专家)推理引擎的重新设计。相比此前方案,新引擎在 token 生成速度上提升了 1.84 倍,且输出精度同步提升。这批改进已直接服务于 Cursor 自研 Composer 模型的训练迭代——这意味着 Cursor 正在从"集成第三方模型"向"构建自有模型能力"深度转型。

原文 + 中文翻译

原文:"We rebuilt our MoE inference engine on Blackwell GPUs — 1.84x faster token generation with better output quality. These improvements are directly feeding into training iterations for our Composer model."

翻译:"我们在 Blackwell GPU 上重建了 MoE 推理引擎——token 生成速度提升 1.84 倍,输出质量更高。这些改进正在直接为 Composer 模型的训练迭代提供支撑。"

深度解读

一、为什么推理引擎重建本身就是一种产品战略

Cursor 此次公告的核心不在于"模型变强了",而在于"基础设施重构了"。MoE 架构的特点是每次推理只激活少数专家网络——以 DeepSeek-V3 为例,671B 总参数中仅 37B 被激活。这意味着推理系统在调度、显存管理和并行策略上有大量定制优化空间。Cursor 选择在 Blackwell 架构上从头重写推理引擎,意味着他们拿到了 H100/H200 之后的新一代硬件红利,同时针对自家 MoE 模型拓扑做了深度耦合。

速度提升 1.84 倍在 AI IDE 场景中有直接体感价值:开发者在等待 AI 补全、解释代码、重构建议时的延迟会从"可感知的等待"下降到"接近实时的反馈"。这对代码补全类场景尤为重要,因为用户期望的是"输入后立即看到建议",而非"等待 2-3 秒"。

二、Blackwell 架构为何是 MoE 的理想载体

NVIDIA Blackwell 架构(GB200 / B100 / B200 系列)相比 Hopper 有几项关键升级:(1) 第五代 NVLink 带宽提升至 1.8 TB/s,使得多 GPU 间的 MoE All-to-All 通信不再成为瓶颈;(2) 新的 Transformer Engine 支持 FP4 量化,对稀疏激活的 MoE 模型压缩效果显著;(3) 更大的 HBM3e 带宽让 37B+ 激活参数的调度更加高效。

Cursor 选择 Blackwell 而非继续在 H100 上优化,说明他们判断 Blackwell 的硬件特性与 MoE 计算模式之间存在足够的匹配度,能够压榨出远超架构移植的收益。这与 OpenAI、Anthropic 等头部玩家向 Blackwell 迁移的趋势一致。

三、"服务 Composer 模型训练"意味着什么

Cursor 此前以"集成 Claude 和 GPT"闻名,但 Composer 是其自研代码生成模型。推理引擎的提速对训练有两个直接帮助:其一,训练样本生成(data synthesis)速度加快,相同周期内可完成更多训练步;其二,推理引擎与模型架构共同优化(co-design),意味着他们在训练阶段就已经在用新的推理基础设施做评估和微调,形成闭环。

这标志着 Cursor 的竞争逻辑从"最好的集成体验"转向"自研模型 + 深度优化"的垂直整合。类比 Figma 从插件生态走向自研渲染引擎,Cursor 正在走类似路径——差异化不再来自 UX,而来自模型-系统联合优化的深度护城河。

值得关注

- Composer 模型何时开放测试:Cursor 在训练基础设施上做出如此大的投入,暗示 Composer 模型已进入较成熟的调优阶段。预计在 2026 Q2-Q3 会有公开评测或 Beta 邀请,关注其 HumanEval / LiveCodeBench 成绩与 Claude Code / Copilot 的对比。

- 1.84 倍提升的基准线是什么:目前未披露对比基准(是相比 H100 上的旧引擎,还是 Blackwell 上的未优化版本),社区等待 Cursor 放出技术博客说明具体优化手段(可能是 tensor parallelism、pipeline parallelism 或 continuous batching 的改进)。

- Blackwell 集群规模与成本:Cursor 作为创业公司,自建或租用大规模 Blackwell 集群的成本极高。需要关注其融资动态或是否有云厂商的深度合作(如与 Lambda Labs / CoreWeave 的 Blackwell 订单)。

- MoE 专家数量与激活策略:Composer 模型使用多少专家、每次激活多少个专家,这直接决定显存占用与推理吞吐。Cursor 若公布架构细节,可与 DeepSeek-V3、Mistral-MoE 等公开 MoE 模型做横向对比。

- 输出质量提升的具体维度:官方称"better output quality"但未量化。需观察后续用户反馈或 A/B 测试数据,尤其在代码补全的上下文理解、长序列生成的连贯性、以及多文件重构场景下的表现。

信源行:

原文链接:https://x.com/cursor_ai/status/2041235628810232243

背景报道:Anthropic 官方技术博客(提供 Claude 模型在 Blackwell 上的部署参考);NVIDIA Blackwell Architecture 技术白皮书(MoE 推理相关的硬件特性说明);The Verge "AI coding tools race heats up"(AI 编程赛道竞争格局报道)。