核心要点

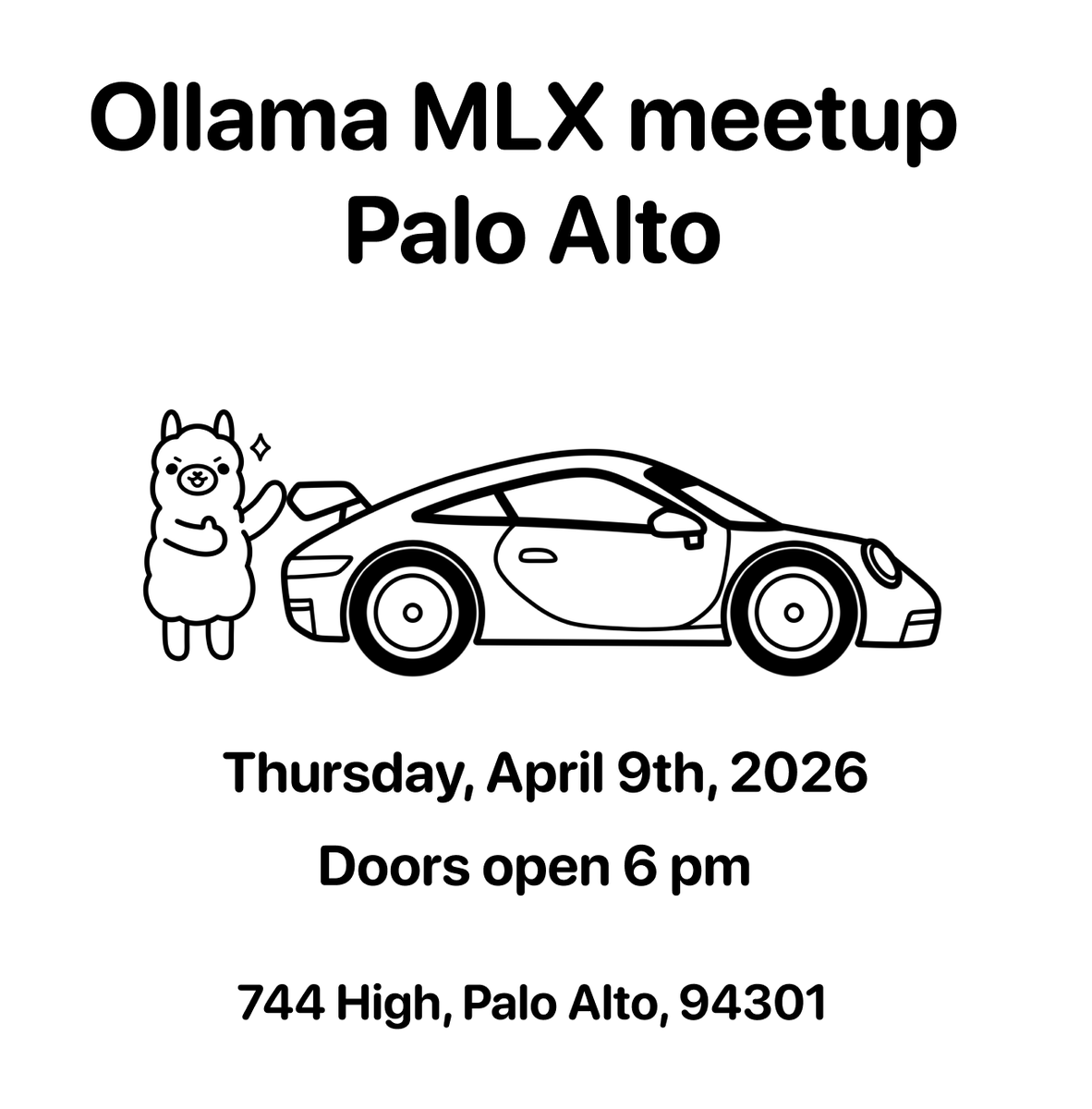

美国时间 2026年4月7日(周一),Ollama 官方账号宣布将于本周四(4月9日)在其 Palo Alto 办公室举办一场以 MLX 为主题的线下社区聚会。Ollama 尚未披露活动具体议程,但明确表示名额有限、需要提前报名,且提供餐饮服务。这是一场以技术交流和社区建设为直接目的的小型线下活动,而非产品发布会。

原文 + 中文翻译

原文:Join us for an MLX-themed meetup at our Palo Alto office this Thursday! Limited spots available—sign up now. Food and drinks will be provided.

翻译:本周四来我们 Palo Alto 办公室参加一场 MLX 主题聚会吧!名额有限,现在就报名。届时将提供餐饮。

深度解读

一、Ollama 正在加码 Apple Silicon 生态布局

Ollama 作为本地大模型推理的事实标准工具,主流支持的是基于 CUDA 的 NVIDIA GPU 环境,以及 AMD ROCm 和 Intel OpenVINO 等后端。然而,Apple Silicon(搭载 M 系列芯片的 Mac)凭借其统一内存架构和出色的能效比,在开发者群体中拥有庞大用户基础。MLX 是 Meta FAIR 团队专为 Apple Silicon 打造的机器学习框架,其设计理念与 Ollama 的"让本地 AI 运行更简单"高度契合。本次聚会暗示 Ollama 很可能正在内部评估或已经着手为 MLX 提供原生支持,这将是其多后端战略的重要一步。

二、为什么这个时间点值得关注

MLX 于 2023 年 12 月正式开源以来,生态处于快速爬坡期,但社区规模和影响力仍落后于 PyTorch 和 JAX 等主流框架。Ollama 选择此时在总部举办 MLX 主题聚会,可能是为了直接触达硅谷一线开发者,收集真实使用场景反馈,甚至现场招募 MLX 相关贡献者。对于 Apple 开发者而言,这释放了一个明确信号:Ollama 不再只是"NVIDIA 生态的工具",而是真正面向全平台的开源推理平台。

三、本地 AI 推理的竞争格局正在分化

从更宏观的视角看,这场聚会折射出本地 AI 推理赛道的竞争已从"功能完备性"转向"生态整合能力"。Ollama 近期面临来自 LM Studio、Jan、GPT4All 等同类工具的直接竞争,而支持更多硬件后端和框架意味着更高的用户迁移成本和更宽的护城河。社区活动则是生态战略的软实力体现——通过面对面的技术交流,Ollama 可以在产品路线图尚未公开时提前建立开发者信任。

值得关注

- Ollama 官方是否会在活动前后宣布 MLX 支持计划:活动时间定在 4 月 9 日,若有重大产品更新,通常会在活动前 24-48 小时发布 announcement。

- MLX 模型在 Ollama 平台上的可用性:目前 Ollama 模型库(library)主要收录的是 GGUF 格式模型,未来是否会引入 MLX 原生模型(如 LLaMA-MLX、Whisper-MLX)值得关注。

- Apple Silicon 在企业级 AI 推理中的渗透率变化:M4 Max 的统一内存已高达 128GB,理论上可运行 70B 参数模型,Ollama 的 MLX 支持将降低这一场景的使用门槛。

- 其他主流推理工具(LM Studio、Jan)的跟进策略:若 Ollama 成功整合 MLX,竞争对手是否会效仿,以及如何差异化竞争。

- Ollama Palo Alto 办公室的战略定位:Palo Alto 是 AI 人才密度最高的地区之一,Ollama 选择在此举办社区活动,可能意味着其正在加速旧金山湾区的招聘和合作伙伴拓展。

信源行:

• 原文链接:https://x.com/ollama/status/2041610283152797818(Ollama 官方 X/Twitter)

• 背景报道:Ollama GitHub 仓库(现有后端支持列表);MLX 官方仓库(Apple Silicon ML 框架)

• 行业背景:Apple Silicon 在本地 AI 推理领域的市场份额增长趋势,以及开源推理工具的竞争格局(参考 TechCrunch、The Verge 相关报道)