Meta AI:详解 Muse Spark 在预训练、强化学习和推理时的 Scaling 特性

Meta 分享 Muse Spark 在三个维度的扩展研究:过去 9 个月重建预训练技术栈,提升了每单位计算量的能力提取效率。

查看原文AI 资讯解读

核心要点

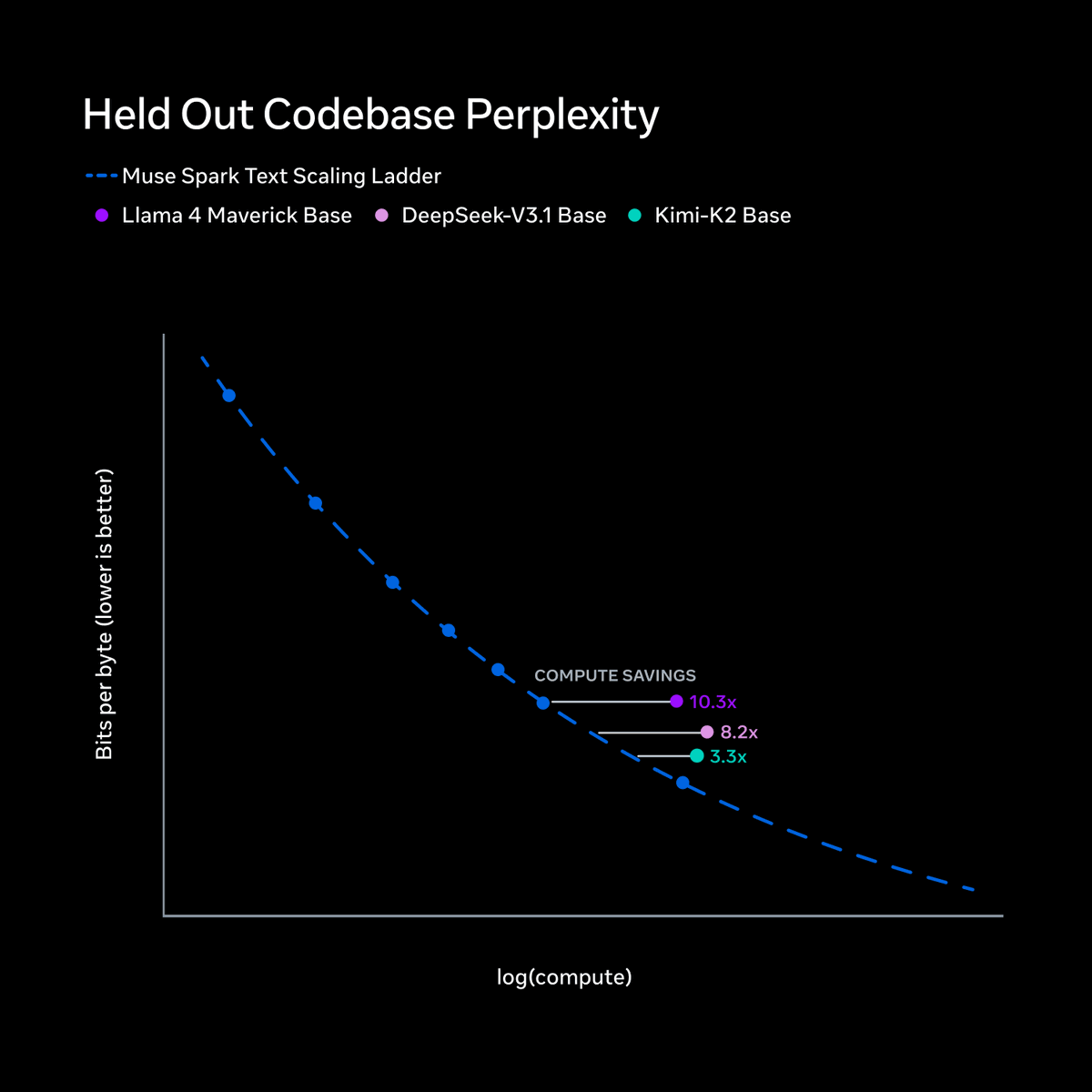

2026年4月8日,Meta AI 通过官方账号 @AIatMeta 发布了关于 Muse Spark 项目在三个关键维度(预训练、强化学习、推理时)扩展特性的系统性研究成果。核心信息是:Meta 团队在过去 9 个月内重建了整个预训练技术栈,显著提升了每单位计算量(FLOPs)的能力提取效率。这表明 Meta 在大模型 Scaling Laws 的工程实践层面取得了实质性突破,从单纯的"更大规模"转向"更高效 Scaling"的战略重心调整。深度解读

从"暴力 Scaling"到"效率 Scaling"的范式转变 这条分享最值得关注的地方在于它揭示了 Meta AI 在 Scaling 策略上的演进。不同于行业内普遍强调的"用更多 GPU、训更大模型"的线性思维,Meta 选择了重建预训练技术栈这一更具挑战性的路径。这意味着他们在基础设施层面(如数据管道、分布式训练框架、显存优化、课程学习设计等)进行了系统性重构,而非仅仅依赖硬件堆叠。9 个月的时间窗口说明这是一次深思熟虑的架构级优化,而非临时打补丁。 三阶段 Scaling 的协同意义 Meta 明确指出了三个 Scaling 维度——预训练、强化学习(RL)和推理时。这三者的协同优化代表了一种更成熟的大模型开发范式。传统观点认为Scaling主要发生在预训练阶段,但 RLHF 和推理时计算(test-time compute)近年来重要性日益凸显。Muse Spark 如果在这三个阶段都展现出正向 Scaling 特性,意味着 Meta 可能找到了一种方法,使模型的"后训练能力"和"推理时的思考预算分配"也能随计算量增长而提升,这对于构建真正意义上有认知深度的 AI 系统至关重要。 对行业竞争格局的潜在影响 从商业角度看,效率 Scaling 意味着同样的硬件投入可以获得更强的模型能力,这直接挑战了"资金壁垒论"——即认为 AI 竞争主要是大厂的资金游戏。如果 Muse Spark 的方法论被验证有效,可能降低行业入门门槛,同时巩固 Meta 在开源生态中的技术领导力。对于 Anthropic、OpenAI 等闭源玩家而言,这也是一个信号:纯靠规模和闭源护城河的战略可能面临效率维度的竞争压力。值得关注

- 后续技术细节披露:关注 Meta 是否会在接下来的 ICLR 2026 或其他顶会上发表相关论文,Muse Spark 的具体技术架构(如是否涉及 MoE、新的注意力机制)将是重要观察点。

- Llama 系列的潜在整合:Muse Spark 的技术成果很可能被整合进下一代 Llama 模型(可能是 Llama 4 系列),预计发布时间窗口为 2026 年下半年,需关注 Llama 发布路线图。

- 效率基准测试结果:需要关注第三方评测(如 LMSYS Chatbot Arena、MMLU、Hendrycks Test)中基于 Muse Spark 方法的模型表现,是否相较前代有显著"效率-能力"比率提升。

- 开源与社区反馈:Meta 是否会将 Muse Spark 相关技术开源(如作为 Llama 的预训练配方)?Hugging Face 社区和独立研究者的复现结果将验证其普适性。

- 行业跟进速度:Google DeepMind、xAI、 Mistral 等是否会在 3-6 个月内发布类似"高效 Scaling"的成果,形成新的技术竞争维度。

信源:@AIatMeta 原推 | 背景报道:The Verge AI 频道(theverge.com/ai)、VentureBeat AI(venturebeat.com/category/ai)均定期追踪 Meta AI 的技术发布动态,可作为补充信源。

本解读由 AI 自动生成,仅供参考。请以原文为准。