核心要点

2026年4月9日,埃隆·马斯克(Elon Musk)在 X 平台发布推文,以戏谑口吻称"如果只用两本书训练 Grok,AI 就大功告成了",配图随即在社区引发广泛讨论。这条看似荒诞的推文实则折射出当前 AI 领域一个核心矛盾:主流大模型依赖海量数据Scaling(规模化)的路线,与小样本高效训练之间的张力。xAI 的 Grok 系列自发布以来一直以"反主流"姿态定位,此次马斯克以极简训练素材作为调侃素材,被普遍解读为对"唯数据论"路线的间接嘲讽,同时也可能暗含对 Grok 模型架构优化路径的暗示。

原文 + 中文翻译

原文:

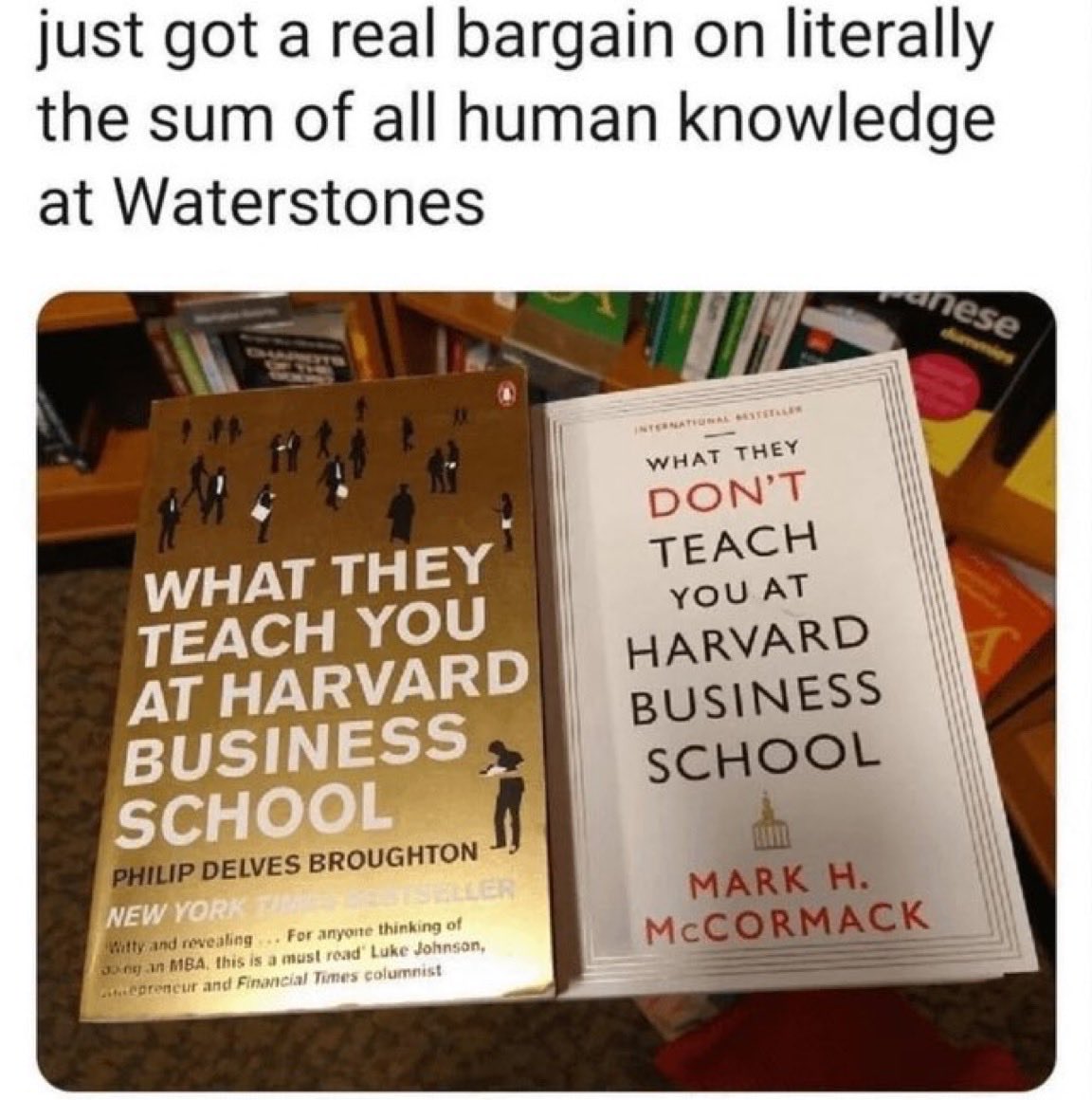

原文:"If you train Grok on just two books, AI is done. You're welcome." — @elonmusk

翻译:"如果只用两本书训练 Grok,AI 就大功告成了。不客气。" — @elonmusk

推文附图(社区热议焦点):图中呈现一本翻开的书籍,旁边标注"仅限两本书"字样,暗示训练素材的极端精简。

深度解读

一、为什么"两本书"是一个精准的行业讽刺

理解这条推文的关键在于它所处的宏观背景。自 GPT-3(2020年)以来,主流大模型遵循的核心范式是"越大越好"(bigger is better)——模型参数规模从数十亿膨胀到数万亿,训练 token 从数千亿到数万亿。然而,这种 Scaling Law 的代价是惊人的算力消耗与数据贪婪。马斯克选择在此时发一条"两本书"的推文,时机耐人寻味:它恰好出现在业界开始系统性反思 Scaling 上限的节点上。2025年下半年至2026年初,OpenAI、Anthropic 和 Google DeepMind 均在不同场合承认,互联网上可用的高质量文本语料正以比预想更快的速度被"耗尽"。当数据瓶颈成为行业共识,马斯克反其道而行之,用"两本书"来解构这一焦虑,其戏谑背后带着几分技术哲学的意味。

二、Grok 的差异化定位与 xAI 的战略意图

xAI 自2023年成立以来,Grok 系列一直没有走主流的"大力出奇迹"路线。Grok-1 首次以开源姿态出现,展示了 MoE(Mixture of Experts,混合专家)架构;Grok-1.5 则引入长上下文能力。但 xAI 真正的差异化在于 Grok 与 X 平台(Twitter)的深度整合——它能实时访问推文流,这是 ChatGPT 和 Claude 等竞品难以复制的独特优势。在此语境下,"两本书"的推文可以被解读为:xAI 认为 Grok 的核心能力并不依赖传统意义上的"大"数据训练,而更多来自独特的实时信息获取渠道和架构设计。这是一种隐性的产品定位宣言——Grok 不需要与 GPT-4 拼参数规模,它的护城河在于信息的实时性与独特的"幽默感"(Grok 一直以"略带讽刺"为产品卖点)。

三、社区反应折射的更深层焦虑

这条推文发布后,X 社区的讨论迅速分化为几个阵营:一部分用户将其视为马斯克一贯的"哗众取宠",认为"两本书"训练 AI 在技术上完全不现实;另一部分用户则认真地将其与 few-shot learning(小样本学习)、meta-learning(元学习)等研究领域联系起来,探讨极端精简训练数据的可行性边界。值得关注的是,这种讨论本身就反映出一个行业焦虑——当 GPU 成本、能耗和数据获取成为大模型的"三重门",整个行业对"Scaling 是否可持续"的质疑正在从学术圈扩散到资本圈和舆论场。马斯克的这条看似轻松的推文,实际上扮演了一个"放大镜"角色,将行业集体潜意识中的疑问具象化为一个让人无法忽视的意象。

值得关注

- xAI 后续技术路线表态:关注 xAI 是否会在官方渠道发布关于 Grok 训练数据来源与规模的说明。当前 Grok-1 及 Grok-2 的技术报告均未公开完整训练数据集构成,"两本书"推文或为 xAI 即将调整信息披露策略的前兆。

- Grok 与 X 平台更深层整合动向:推文的隐含逻辑指向 Grok 的独特优势来自 X 平台的实时数据,而非传统静态语料库。预计2026年下半年 X 平台将推出 Grok 深度嵌入功能(如搜索排序辅助、账号分析等),需关注此类功能对平台生态的影响。

- 行业对数据瓶颈的应对方案进展:Synthetic data(合成数据)、web-scale filtered data、multimodal data 扩展等方向的主要玩家(OpenAI、DeepMind、Meta AI)近期均有论文或产品发布。可追踪 Q2-Q3 2026 学术会议(NeurIPS、ICML)相关论文录用情况。

- 马斯克旗下其他 AI 资产的联动效应:xAI 与 Tesla AI(自动驾驶视觉模型)、Optimus(人形机器人)之间存在技术协同潜力。"两本书"玩笑是否暗示 xAI 在探索极度压缩的高效训练范式,并将该范式迁移至 Tesla AI 的视觉处理模块,值得追踪。

- 社区对推文的二次创作与 meme 传播路径:此类病毒式传播的内容往往在24-72小时内形成稳定的 meme 变体。建议监测 Reddit r/MachineLearning、r/artificial 以及 Hacker News 的相关讨论线程,观察技术社区是将此推文作为"认真讨论的起点"还是"纯娱乐事件"来处理。

信源行:

原文链接:https://x.com/elonmusk/status/2042125968052302319

背景报道:

· xAI 官方技术博客(Grok-2 技术报告)

· The Verge 2026年3月刊文《The AI data squeeze: Why companies are running out of training material》

· VentureBeat 2026年4月刊文《Musk's xAI bets on real-time data as the moat for Grok amid scaling law doubts》