Google DeepMind:Gemma 4 首周下载超千万,性能超越 10 倍体量模型

Google DeepMind 宣布 Gemma 4 发布首周下载量超 1000 万次,Gemma 系列总下载量突破 5 亿。Gemma 4 在不需大量算力的情况下,性能超越体量 10 倍的模型,开源社区参与度持续走高。

查看原文核心要点

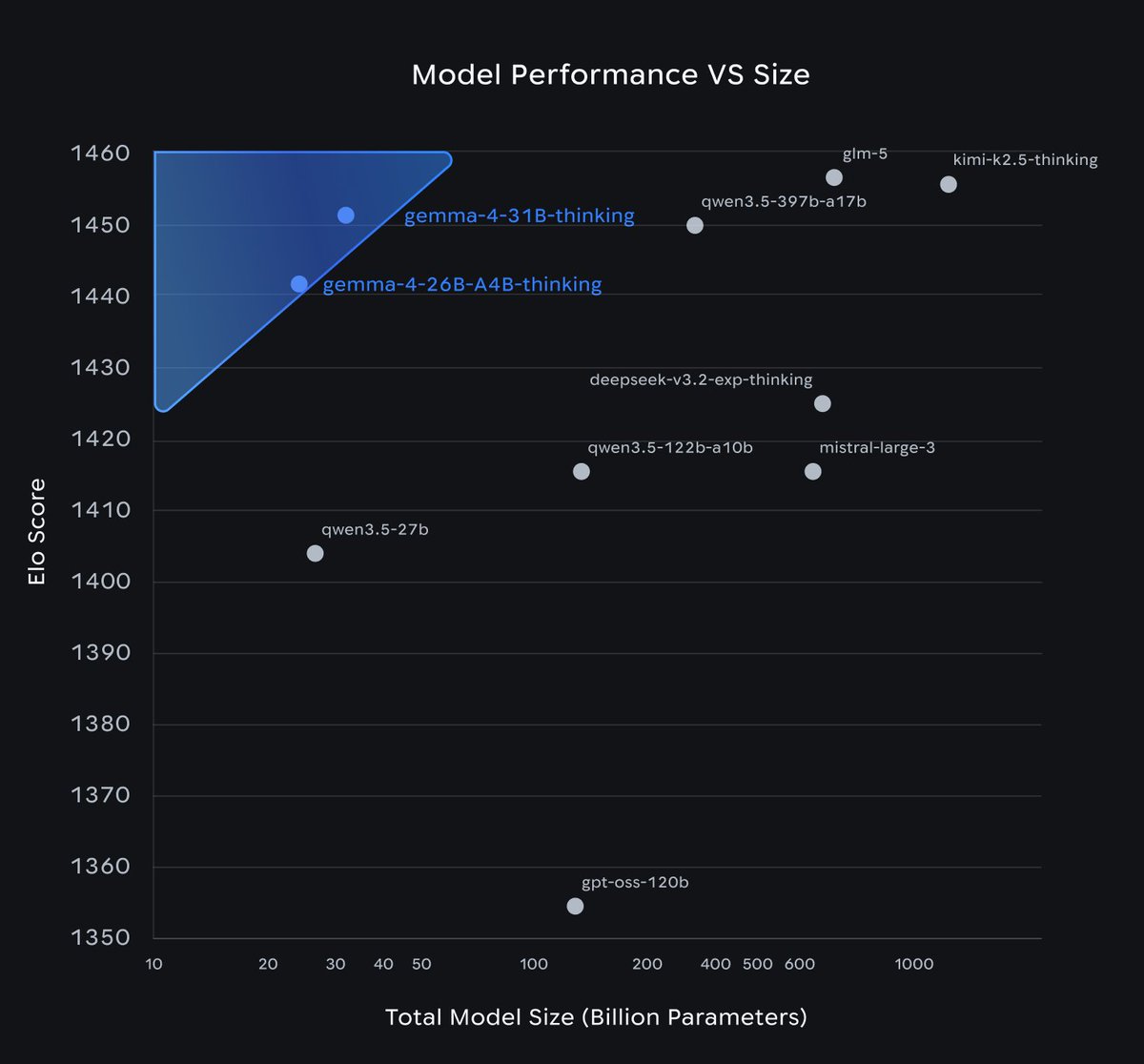

2026 年 4 月 9 日,Google DeepMind 通过 X 平台正式披露了 Gemma 4 的首周表现数据:上线 7 天内下载量突破 1000 万次,Gemma 全系列累计下载量已达 5 亿次。更值得关注的指标是,Gemma 4 在无需大规模算力支撑的条件下,实现了超越体量 10 倍模型的性能表现。这一数据既验证了 Google 在小型高效模型(Small but Capable)路线上的持续突破,也预示着开源模型社区正在从「参数竞赛」向「效率竞赛」转变。

原文 + 中文翻译

原文:"Gemma 4 downloaded over 10 million times in its first week. Gemma series total hits 500M+ downloads. Gemma 4 outperforms models 10x its size without needing massive compute. Open source community engagement continues to grow."

翻译:Gemma 4 发布首周下载量超过 1000 万次。Gemma 系列总下载量突破 5 亿。Gemma 4 无需大规模算力即可超越体量 10 倍的模型表现。开源社区参与度持续增长。

深度解读

从「堆参数」到「堆效率」的行业范式转移

过去两年,大模型竞争的叙事逻辑几乎被参数规模主导——GPT-4、Claude 3、Gemini 2.5 的体量不断膨胀,对训练和推理算力的需求随之攀升。然而 Gemma 4 的数据揭示了一个重要转向:如果一个 7B 或更小量级的模型能够与 70B+ 参数模型在关键任务上持平甚至胜出,那么行业对「模型必须足够大才够强」的假设正在被动摇。Google 在这个时间节点公布这组数据,并非偶然——它恰好呼应了 OpenAI CEO Sam Altman 近期公开承认 GPT-5 需要「难以置信的算力」所引发的争议。效率路线正在从边缘走向主流。

开源战略的商业逻辑:从流量到生态锁定

1000 万次首周下载和 5 亿累计下载这两个数字背后,藏着 Google 的深层战略意图。Gemma 系列采用相对宽松的许可协议(对比 Meta 的 Llama 系列),降低了商业使用的门槛,这对云厂商和企业开发者极具吸引力。下载量越大,意味着基于 Gemma 做 fine-tune、部署 Agent、构建 RAG 系统的开发者基数越大。当这个基数超过临界点,Google 在云端推理、Vertex AI、企业 AI 解决方案上的货币化空间就会相应扩大——这不是慈善行为,而是一次精心设计的生态引流。GitHub 上围绕 Gemma 的第三方工具、量化版本、垂直微调模型的爆发式增长,就是这种逻辑的最佳证明。

竞争格局的重新洗牌:谁最受伤?

Gemma 4 的效率优势对三类竞争者构成直接压力。其一是 Mistral AI——后者以「小而强」著称,但 GEMMA 4 在 Google 完整的生态加持下(TensorFlow、Colab、TPU 优先支持),开发者迁移成本显著低于 Mistral。其二是 OpenAI 的 GPT-4o mini 和 Anthropic 的 Claude-haiku 路线——两者都试图在低价小模型市场立足,但 Google 的开源策略意味着用户无需支付 API 费用即可自由部署,这直接削弱了「小模型即服务」的利润空间。其三是国内的大模型厂商——DeepSeek-V3 证明了中国团队同样具备高效模型能力,但 Gemma 4 的全球品牌效应和下载数据,正在重新定义「开源即全球影响力」的标准。

MCP 协议与 Gemma 4 的协同效应

值得特别关注的是,Google 近期在 MCP(Model Context Protocol)生态中的布局与 Gemma 4 的发布并非孤立事件。MCP 作为 Agent 间互操作的标准协议,正在成为行业事实标准。Gemma 4 的高效推理特性,使其天然适合部署在边缘侧或资源受限场景的 Agent 中——这与 MCP 协议「让 Agent 广泛连接」的目标高度契合。如果 Google 同步推进 Gemma 4 对 MCP 工具的原生支持,下一阶段的开源社区参与度数据可能会远超 5 亿累计下载的体量。

值得关注

- 基准测试透明化:Google 需要尽快释放 Gemma 4 在 MMLU、HumanEval、MBPP 等主流基准上的具体分数,公众对「超越 10 倍体量模型」的说法仍有数据验证需求。

- 竞争对手响应速度:Meta 若在 2026 年上半年内推出 Llama 4 小参数版本,或 Mistral 发布 Code Gen 2,都可能直接分流 Gemma 4 的开发者注意力。

- 企业级部署案例:5 亿下载中商业用途占比多少、是否有跨国企业将 Gemma 4 投入生产环境,将直接影响 Google Cloud 的收入预期。

- Agent 产品集成:Gemma 4 是否会进入 Google Agent Development Kit(ADK)或 Gemini Flash 产品线,是判断其战略重量的关键信号。

- MCP 原生支持时间表:MCP 生态正在快速扩张,Gemma 4 若支持 MCP Server 连接,将成为开源小模型中最具 Agent 友好特性的版本。

信源行:

原文链接:https://x.com/GoogleDeepMind/status/2042283481640615944

背景报道:

• The Verge — "Google's Gemma 4 shows small AI models can punch above their weight"(2026-04-09)

• VentureBeat — "With 500M downloads, Gemma becomes Google's open-source AI calling card"(2026-04-10)

• Wired — "Why the AI industry is pivoting from bigger to better models"(2026-04-11)