核心要点

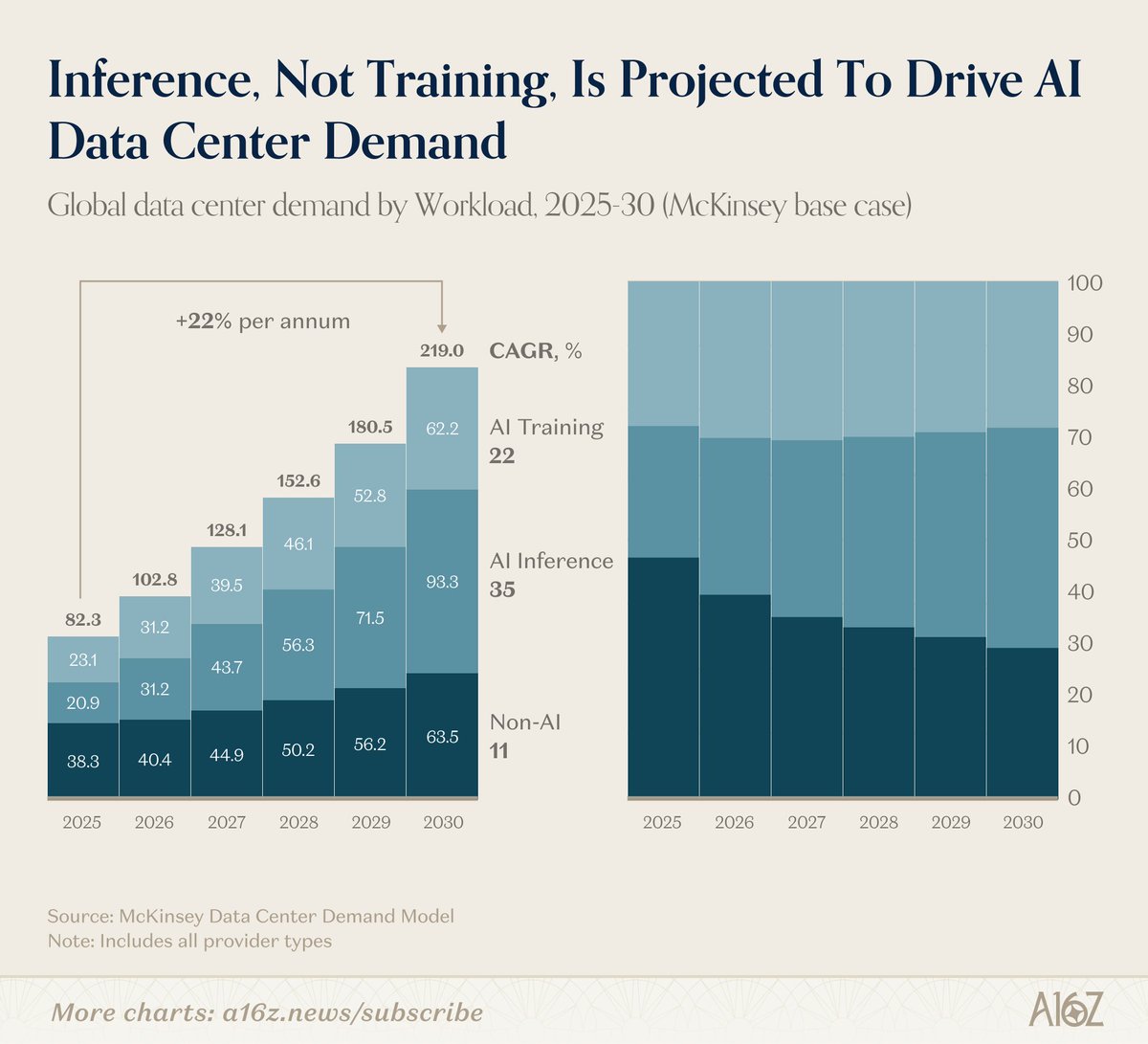

2026 年 4 月,顶级风投 a16z(Andreessen Horowitz)通过社交媒体发布了一张数据图表,核心结论极为明确:AI 推理(Inference)即将取代模型训练(Training),成为驱动数据中心新一轮大规模扩建的核心动力。这意味着 AI 行业的主要资本支出方向正在发生结构性转移——从"建算力训练模型"转向"部署模型服务用户"。

深度解读

一、训练时代正在翻篇

过去五年,数据中心扩建的核心叙事是「训练大战」:OpenAI、Anthropic、Google DeepMind 等公司疯狂囤积 H100 / H200 GPU,核心目标是训练出更强的基础模型。这种需求催生了微软 Azure、AWS、CoreWeave 等百亿级基础设施投资。然而,训练的本质是一个「有时间窗口的一次性事件」——模型训练完成后,同样规模的算力不会持续满载。因此当基础模型迭代速度趋于放缓(GPT-4 之后,GPT-5 的节奏也并非月月迭代),训练侧的算力需求增速会自然趋缓。

二、推理的规模化逻辑完全不同

推理(Inference)则是完全不同的商业模型。当数百万用户同时向大模型发送请求时,每一次对话、每一次代码补全、每一次多模态内容生成,都需要消耗大量 token 计算。更关键的是:用户请求是持续性的、不可预测的、和高度并发性的。ChatGPT 在 2023 年初爆炸式增长时曾导致服务多次中断,根本原因就是推理算力不足。这与训练阶段「集中训练数周」的模式截然不同——推理需要 7×24 小时、弹性扩展、地理分布式部署。

这就解释了为什么 a16z 认为推理将主导扩建:一旦模型部署到生产环境并积累了稳定用户群,推理的算力消耗往往是持续且可预期的倍数于训练成本。以 GPT-4 级别模型的推理为例,实际运营中推理成本可达训练成本的数十倍甚至百倍。

三、行业影响:从 GPU 战争到「推理即服务」

这一趋势如果成立,将对多个产业环节产生深远影响:

- GPU 需求结构变化:训练型 GPU(如 H100)销售增速将趋于平稳,而针对低延迟、低能耗推理优化的芯片(如 NVIDIA 的 H200/B100,或 AMD MI300X)需求将显著上升。

- 云厂商商业模式重构:AWS、Azure、Google Cloud 的定价模型将更偏向「按 token 收费」,基础设施的 CapEx 会从一次性大规模采购转向更持续的滚动投入。

- 小模型与蒸馏技术的价值重估:如果推理成本是核心瓶颈,那么能以更低算力完成特定任务的小模型(Llama 3 8B、GPT-4o mini 等)将获得大量部署,这会反向刺激小模型生态。

- 芯片层竞争加剧:推理侧对芯片的能效比(TOPS/W)要求极高,这为 Cerebras、Graphcore、以及大量 AI 芯片初创公司提供了比训练市场更公平的竞争窗口。

四、值得关注的风险点

a16z 的这一判断并非没有争议。有观点认为,随着模型能力持续提升,单次推理所需的算力也在增加(长上下文、多模态、Agent 任务链),因此推理算力增长可能不会如预期那样"替代"训练,而是与训练并行增长。这意味着数据中心扩建可能是「双轮驱动」而非「替换」。此外,如果 AI 应用增长不如预期(如用户使用频次趋于饱和),推理需求的增速同样可能被高估。

值得关注

- NVIDIA 财报中的推理收入占比:2026 年 Q1/Q2 财报中,数据中心业务里推理相关收入是否已经超过训练?关注黄仁勋在财报电话会中对「推理驱动」的措辞变化。

- CoreWeave 与其他 AI 专属云厂商的扩建节奏:CoreWeave 已提交 IPO 招股书,其基础设施扩张计划将直接反映推理需求预期。

- 小模型部署量数据:Hugging Face 上模型的月下载量趋势,以及 Mistral、Llama 系列模型在企业侧的采纳率,是推理需求的前置指标。

- OpenAI o3/o4 系列模型的商业化进展:o 系列推理模型因需要多次「内部思考」token,其单次请求的推理成本远高于传统模型,是推理成本结构的重要测试案例。

- AWS/Azure/Google Cloud 2026 年 CapEx 指引:三大云厂商的年度资本支出计划中,针对推理基础设施的投资占比变化。

信源行:

• 原文链接:a16z X(Twitter)原文图表

• 背景报道:Morgan Stanley:全球数据中心电力需求预测(2026);NVIDIA 官方博客:数据中心推理需求更新(2025)