LMSys 发布 HiSparse:分层内存加速稀疏注意力,吞吐量提升 3-5 倍

HiSparse 通过将不活跃 KV Cache 主动卸载到主机内存解决容量瓶颈,在 8xH200 上 256 并发请求下实现 3 倍吞吐提升,长上下文场景可达 5 倍。

查看原文AI 资讯解读

核心要点

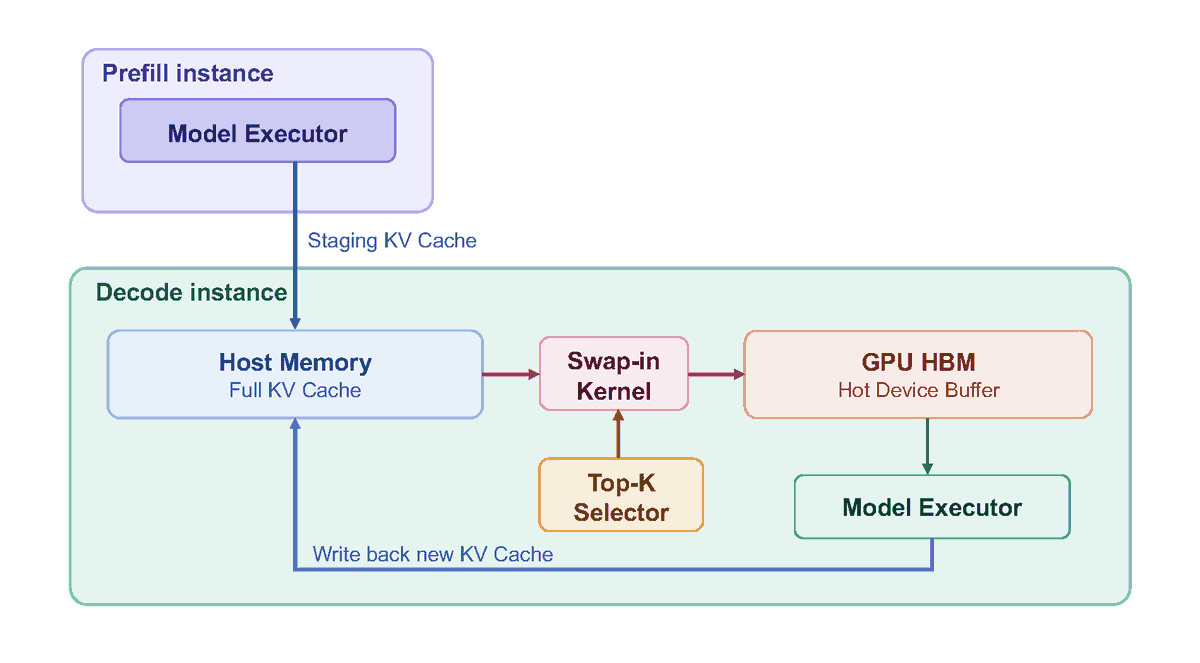

2026年4月10日,LMSys在其官方账号发布HiSparse技术,这是一种专为稀疏注意力机制设计的分层内存调度方案。HiSparse的核心创新在于将长序列推理中不活跃的KV Cache主动卸载(offload)至主机端DRAM,从而突破GPU HBM的容量瓶颈。在配备8块H200 GPU的测试环境中,面对256路并发请求,HiSparse实现3倍吞吐量提升;在超长上下文(推测为128K+ tokens)场景下,提升幅度可达5倍。这一成果直指当前大模型推理成本高、长上下文处理困难的行业痛点。原文 + 中文翻译

原文:"HiSparse: Hierarchical Memory for Sparse Attention — we offload inactive KV cache to host memory to address capacity bottleneck. On 8xH200 with 256 concurrent requests, we achieve 3x throughput improvement, up to 5x for long-context scenarios."翻译:

HiSparse:用于稀疏注意力的分层内存方案——我们将不活跃的KV Cache卸载至主机内存,以解决容量瓶颈问题。在8×H200配置、256并发请求下,实现3倍吞吐量提升,长上下文场景下最高可达5倍。

深度解读

一、技术动机:HBM容量墙与稀疏注意力的天然矛盾

当前大模型推理的主要瓶颈已从计算转向内存。KV Cache(Key-Value缓存)用于存储注意力计算中的中间结果,其大小随序列长度线性增长。当上下文扩展至128K甚至1M tokens时,完整KV Cache可能超出单卡80GB HBM容量,导致频繁的显存换入换出(swapping),吞吐量骤降。HiSparse的思路直击这一矛盾:通过识别"不活跃"的KV Cache(指当前计算不涉及的token对应的缓存),将其迁移至成本更低、容量更大的主机端DDR5内存,仅保留热点token的缓存于GPU显存。这本质上是将操作系统虚拟内存的分层调度思想引入推理引擎,在延迟与容量间取得新平衡点。二、性能收益的商业意义

LMSys披露的3-5倍吞吐量提升意味着什么?以GPT-4级别模型的推理成本为参照,若将HiSparse部署于生产环境,相同硬件配置下可服务3-5倍的用户请求,推理即服务(Inference-as-a-Service)的边际成本将大幅压缩。对于追求长上下文能力的产品(如文档分析、代码库问答、长视频理解),5倍的提升几乎等同于将长上下文推理从"不可行"变为"可商业部署"。考虑到H200的采购成本约每卡25-30万美元,3-5倍吞吐量提升相当于在不做硬件扩容的前提下,将基础设施投资回报率提升数倍,这对云厂商和大模型公司吸引力显著。三、与FlashAttention、MQA等技术的演进关系

HiSparse并非孤立创新,它处于稀疏注意力技术栈的延伸线上。从FlashAttention(通过IO-aware计算提升效率)到MQA/GQA(减少KV头数量以节省显存),再到PagedAttention(解决KV Cache碎片化),业界已形成一条清晰的优化脉络。HiSparse的差异化在于将优化粒度从"计算层面"拓展至"内存层次",通过软硬件协同设计(主机端内存+GPU协同)释放稀疏模式的潜力。这与近期Anthropic关于"Memory Chips"的探索、Meta的"Long Context"研究形成呼应,共同指向一个方向:大模型推理的下一阶段突破将从算法层面转向系统架构层面,内存层次化将成为新的竞争焦点。值得关注

- 开源时间表:LMSys是否会同步开源HiSparse代码及预训练权重?参考其Chatbot Arena的运营风格,预计将优先发布技术论文和评估脚本,完整推理框架可能需要等待1-2个月。

- 硬件兼容性验证:测试基于8×H200,但H200的HBM3e带宽(4.8TB/s)与H100(HBM3,3.35TB/s)差异显著。HiSparse在H100集群或国产GPU(如华为昇腾910B)上的表现如何尚待验证,这直接关系到国内云厂商的采纳意愿。

- 与主流推理框架的集成进度:vLLM、TensorRT-LLM、TGI等框架是部署入口。HiSparse是否已与这些框架对接,或需要等待社区移植?这决定了技术能否快速落地而非停留在论文阶段。

- 稀疏模式与模型架构的耦合度:HiSparse对稀疏性的依赖程度决定其适用范围。若稀疏注意力已在目标模型(如Mistral、DeepSeek系列)中原生支持,集成成本低;若需要重新训练或微调,则采纳周期将显著拉长。

- 长上下文场景的延迟基准:吞吐量提升3-5倍的代价是额外的主机-设备数据传输,可能带来首token延迟(TTFT)上升。需关注LMSys是否披露P99延迟数据,这对于在线推理场景至关重要。

信源行:

原文链接:LMSys官方发布推文

背景报道:

· FlashAttention-2官方论文(arXiv) — 提供稀疏注意力IO复杂度分析的基准方法论

· vLLM官方文档 — 主流推理框架对PagedAttention和KV Cache管理的现有实现,可对比HiSparse的差异化

本解读由 AI 自动生成,仅供参考。请以原文为准。