vLLM:驱动 Chandra-OCR-2 大规模论文识别,单卡 L40S 每小时处理约 60 篇论文

vLLM 为 Chandra-OCR-2(5B 参数)提供推理支持,在 16 个并行任务下单卡 L40S 每小时处理约 60 篇论文,展示了 vLLM 在大规模 OCR 场景的性能。

查看原文核心要点

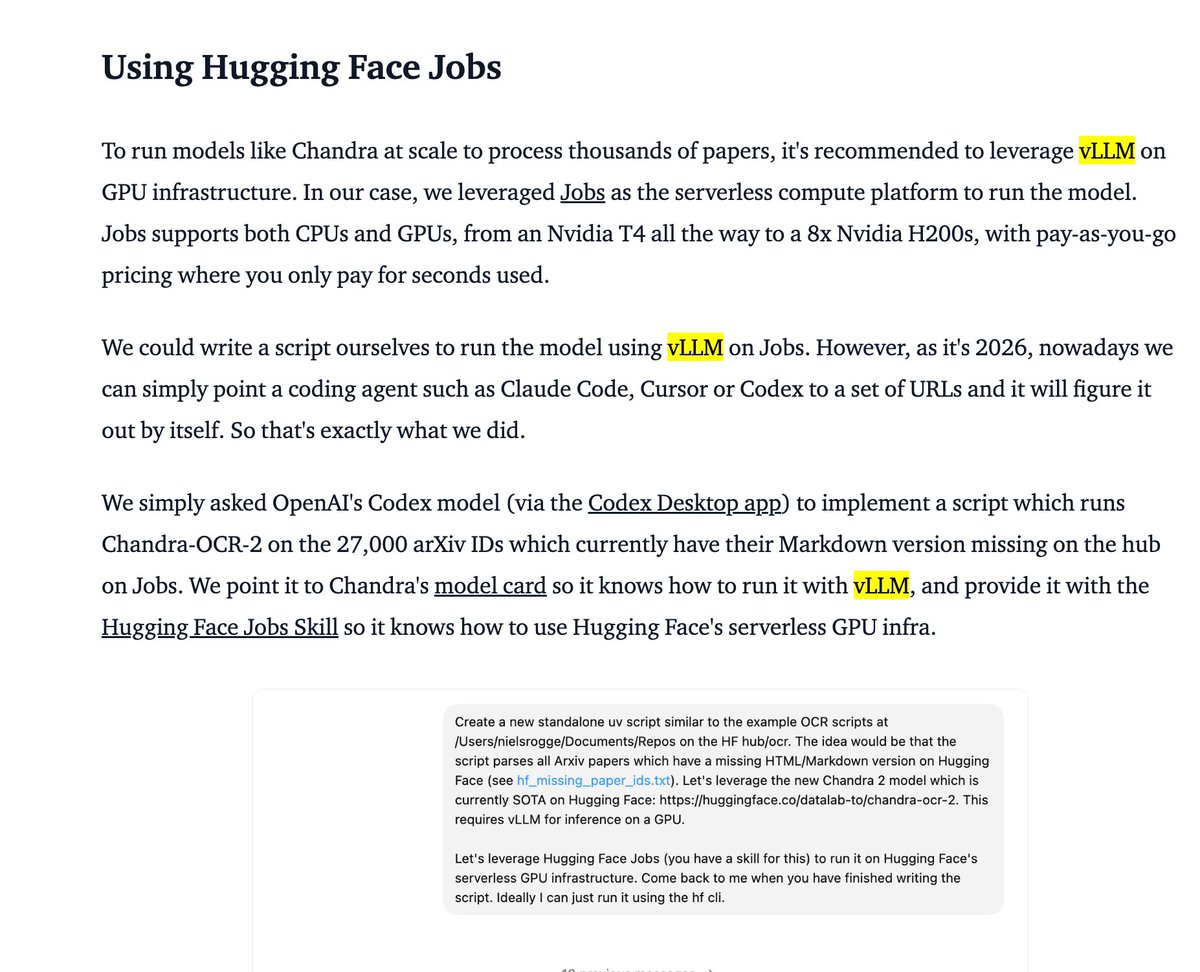

2026年4月14日,vLLM 官方披露其推理引擎已支持 Chandra-OCR-2(5B 参数)模型,在单张 NVIDIA L40S GPU 上通过 16 个并行任务,实现每小时约 60 篇学术论文的结构化识别。这一数据意味着 vLLM 正在将大语言模型推理能力从对话场景拓展至大规模文档处理流水线,其 PagedAttention 和连续批处理技术在此类场景中展现出显著的吞吐优势。

原文 + 中文翻译

原文:

We enabled inference for Chandra-OCR-2 (5B params) with vLLM — processing ~60 papers/hour on a single L40S GPU with 16 parallel tasks. 🔗

翻译:

我们使用 vLLM 为 Chandra-OCR-2(5B 参数)启用推理支持——在单张 L40S GPU 上通过 16 个并行任务,每小时处理约 60 篇论文。

深度解读

1. vLLM 的推理优化路径:从对话到文档处理

vLLM 最早因解决 LLM 服务中内存碎片化和吞吐量瓶颈而闻名,其核心机制 PagedAttention 允许 KV Cache 的灵活分页管理,将 GPU 显存利用率显著提升。此次应用于 OCR 场景(Chandra-OCR-2 是一款面向学术文献的结构化识别模型),意味着 vLLM 的技术边界正在从生成式对话向视觉-语言多模态推理延伸。5B 参数的模型在 L40S 这类非 H100/H100 旗舰级 GPU 上跑出 60 篇/小时,证明了 vLLM 对中端硬件的适配能力正在成熟。

2. 大规模学术文档数字化的商业价值

每小时 60 篇论文的处理速度,若以 8 小时工作制计算,单卡日处理量可达 480 篇,月累计约 14,400 篇。这意味着学术出版商、研究机构乃至政府知识库项目,可以以相对低的硬件成本构建大规模文献解析流水线。考虑到全球每年新发表学术论文约 300-400 万篇,若部署 100 张 L40S 集群,理论上可在一个月内完成一轮全量扫描。Chandra-OCR-2 的 5B 规模表明其具备足够的能力来处理复杂排版、多语言混排和表格识别,而 vLLM 提供的并发支撑则解决了"部署易、上量难"的工程痛点。

3. 与当前 AI 基础设施竞争格局的关联

值得注意的是,L40S 并非英伟达最新一代 GPU(H200、B200),而是基于 Ada Lovelace 架构的中端数据中心卡。vLLM 在此类硬件上实现高吞吐,暗示着 AI 推理正在从"堆算力"向"软件优化"转变。这与近期 OpenAI、Anthropic 推进的模型量化、投机解码(Speculative Decoding)趋势一致——行业正试图用更少的硬件、更低的成本服务更大的模型推理需求。对比来看,若同等吞吐量需在 H100 上实现,成本可能高出 2-3 倍,vLLM + L40S 的组合在成本敏感型场景中具有竞争力。

值得关注

- Chandra-OCR-2 的模型来源与技术背景:5B 参数的 OCR 模型在学术界并不常见,需确认其是否为开源模型(如基于 Qwen2-VL、PaliGemma 微调),还是某家公司的商业产品。了解其训练数据和识别精度基准将有助于评估其商业可用性。

- vLLM 对多模态模型的支持成熟度:vLLM 传统上以纯语言模型推理见长,此次支持视觉-语言模型(如 OCR)需要关注其对图像输入 KV Cache 的管理机制是否已优化,吞吐量是否还有进一步提升空间。

- L40S 与 H100 在此类任务中的性价比对比:若后续有团队在 H100 上复现相同任务,可横向对比延迟、吞吐和单篇论文处理成本,这将影响大规模部署的硬件选型策略。

- 学术文献数字化市场的竞争动态:Semantic Scholar、Elsevier、Springer Nature 等机构均在推进自动化论文结构化。vLLM + Chandra-OCR-2 的组合是否会冲击现有解决方案(如 AWS Textract、Google Document AI)值得追踪。

- vLLM 官方社区的后续功能更新:关注 vLLM GitHub 仓库是否新增对视觉模型的 benchmark 文档或优化指南,这将影响开源社区的采用速度。

信源行:

原文链接:vLLM 官方推文(X/Twitter)

背景报道:

• vLLM 官方文档(含 PagedAttention 技术细节)

• arXiv 论文处理与 OCR 相关研究(学术背景)

• vLLM GitHub 仓库(持续追踪多模态支持进展)