swyx:AI 工程的核心是推动 Pareto 前沿而非硬突破模型边界

swyx 总结 AI 工程方法论:不要试图直接突破模型能力边界,而应先通过模型+框架组合最大化能力,再进行蒸馏。这一策略在实践中几乎总是有效。

查看原文AI 资讯解读

核心要点

2026年4月15日,知名 AI 工程师与播客主 swyx 在 X 平台发表观点,系统性阐述 AI 工程方法论:不应执着于直接突破基础模型的性能边界,而应优先通过"模型+框架"组合实现能力 Pareto 最优,再通过蒸馏将复杂 Pipeline 压缩为单一高效模型。这一"先组合后蒸馏"的策略被 swyx 判定为在实践中几乎总是更优的选择,反映了当前 AI 工程领域从"暴力 scaling"向"系统工程优化"的方法论转向。原文 + 中文翻译

原文: "The core of AI Engineering is not pushing the Pareto frontier of model capability. It is pushing the Pareto frontier of the model + framework combination. The latter always dominates. Do that first, then distill. This strategy works almost always in practice." 翻译: "AI 工程的核心并非推动模型能力的 Pareto 前沿。而是推动模型 + 框架组合的 Pareto 前沿。后者始终更优。先做到这一点,再进行蒸馏。这一策略在实践中几乎总是有效。"深度解读

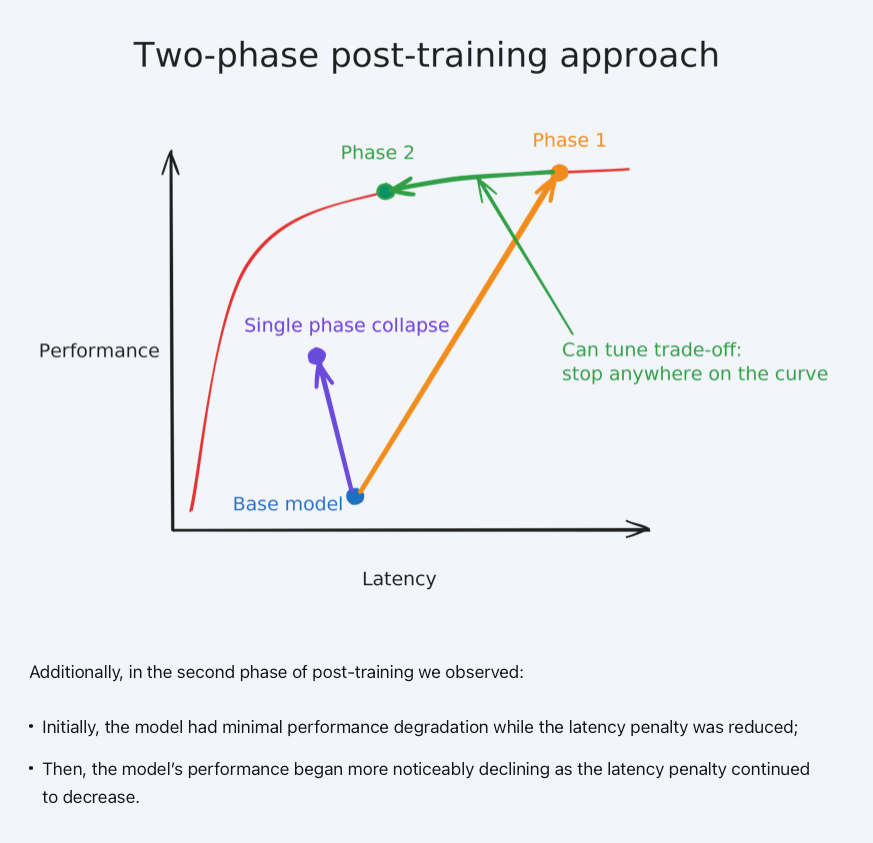

方法论重构:从"模型中心"到"系统中心" swyx 的核心洞见在于重新定义了 AI 工程的优化目标。当前行业普遍存在一种惯性思维:将 AI 能力提升等同于基础模型(Foundation Model)的性能突破,企业和研究者不惜重金训练更大规模的 LLM。然而 swyx 指出,这种路径的边际收益正在递减。真正可工程化的 Pareto 前沿存在于"模型 + 框架"的组合层面——一个经过精心设计的 Agent Pipeline、多模态处理框架或特定领域的推理架构,往往能在不更换基础模型的前提下实现质的飞跃。这一观点与近期业界对"Test-Time Compute"和"Chain-of-Thought Scaling"的关注形成呼应,暗示计算资源的分配重心正从训练阶段向推理阶段迁移。 蒸馏作为能力压缩的关键桥梁 该方法论的另一半精髓在于"先组合后蒸馏"的时序策略。在组合阶段,工程师可以自由引入外部工具(浏览器、代码执行器、检索系统)、设计复杂的推理链路、调用多个专业模型协同工作——这些都会带来显著的 latency 和 cost,但在探索阶段是必要的技术债。swyx 的主张是:不要急于消除这些成本,而是先验证组合方案的有效性,确认其确实推进了 Pareto 前沿后,再通过蒸馏将复杂的 Pipeline 提炼为单一模型,实现性能与效率的统一。这一思路与 OpenAI o1/o3 的 CoT Distillation、Anthropic 的 Claude Computer Use 项目中隐含的"先让机器用笨办法,再用聪明办法压缩"的设计哲学高度一致。蒸馏在此不再是简单的模型压缩技术,而成为工程迭代闭环中的关键环节。 对 AI 原生公司战略选择的影响 这一方法论对 AI 应用的商业策略具有直接启示。对于资源有限的初创公司,与其押注自研基座模型与 OpenAI、Google 正面竞争,不如聚焦于垂直场景的"模型 + 框架"组合优化。例如,一个法律 AI 产品可以先基于 GPT-4o + RAG + 外部法律数据库 API 构建原型 Pipeline,验证用户需求和技术可行性后,再考虑蒸馏为专用小模型。这大幅降低了验证成本和技术风险。swyx 本人此前在《Latent Space》播客中多次强调的"AI 工程的二阶思维"——即不只看模型本身,还要看模型所处的系统上下文——在此得到了系统性的方法论表达。 与 Agent 架构发展的内在关联 这一观点的流行也与 2025-2026 年 Agent 架构的成熟紧密相关。当 Agent 不再是简单的"模型 + Prompt"而是包含 Planning、Memory、Tool Use 多组件的复杂系统时,系统层面的 Pareto 优化变得愈发重要。swyx 的框架为理解这一趋势提供了元方法:无论 Agent 形态如何演进,"模型 + 框架"的 Pareto 前沿始终是工程优化的主战场。这与 LangChain、Llamaindex 等框架近年来从"LangChain 是胶水代码"到"LangChain 是基础设施"的定位演变相呼应——框架本身正在成为 AI 工程的核心研究对象,而非仅仅是模型的附庸。值得关注

- Anthropic MCP 生态的 Pareto 表现:MCP(Model Context Protocol)的普及程度及其是否真正实现了"模型 + 框架"层面的能力跃迁,可作为该方法论有效性的观测窗口。预计 2026 年 Q3 前会有较多基于 MCP 的生产级案例披露。

- OpenAI o4 系列的能力边界:如果 o4 在 Agent 任务上相比 o3 的提升主要来自推理框架优化而非模型 scaling,将是该方法论的强力佐证。

- 开源蒸馏工具链进展:Axolotl、LLM-Pruner 等蒸馏框架的更新频率,以及是否出现新一代"组合到单模型"的一站式方案(如类似 DistillBERT 的领域专用蒸馏流程)。

- 企业 AI 采购决策的变化:企业是否会从"购买最强基础模型 API"转向"购买经过框架优化的垂直解决方案",Gartner 和 Forrester 2026 年中期的报告可提供数据支撑。

- swyx 本人的实践案例:关注 swyx 在《Latent Space》或个人博客中是否会有具体项目展示"组合先行、蒸馏在后"的完整 Pipeline,这将提供方法论落地的具体参考架构。

信源行:@swyx (https://x.com/swyx/status/2044234661644382581) | 背景报道:《Latent Space》播客 swyx 相关 episode(讨论 AI 工程方法论);《The State of LLM Agents 2025》(对"模型+框架"组合范式的系统性梳理)

本解读由 AI 自动生成,仅供参考。请以原文为准。