a16z:物理 AI 或将进入独立的 Scaling 阶段

a16z 的 Oliver Hsu 认为当下 AI 主导范式仍是语言与代码,但过去 18 个月物理 AI 同步成熟,机器人学习、自主科研等新方向有望进入属于自己的 Scaling 规律。

查看原文核心要点

2026 年 4 月中旬,a16z 基础设施投资团队核心成员 Oliver Hsu 在 X 平台发表评论,指出当前 AI 主导范式的核心仍是语言与代码 Scaling,但过去 18 个月中,物理 AI(Physical AI)已同步成熟并正在形成自己独立的 Scaling 规律。这一判断意味着机器人学习(robotics learning)、具身智能(embodied AI)以及 AI 驱动的基础科学研究不再是语言大模型的附属应用,而正在进入自我强化、规模递增的正向循环,其背后的算力需求、数据结构和训练范式均与传统 LLM 存在本质差异。

原文 + 中文翻译

原文:"The dominant AI paradigm still runs on language and code scaling. But over the past 18 months, Physical AI has been maturing in parallel — and it now appears to be entering its own scaling regime for robotics learning, autonomous science, and beyond." — Oliver Hsu, a16z

翻译:"当前主导的 AI 范式仍然基于语言和代码的 Scaling。但在过去 18 个月里,物理 AI 已同步成熟——现在它似乎正在进入属于自己的 Scaling 阶段,涵盖机器人学习、自主科学研究等领域。" — Oliver Hsu,a16z

深度解读

1. 为什么物理 AI 的独立 Scaling 值得关注

过去三年,AI 行业几乎将所有注意力集中在 LLM 的语言 Scaling 上——GPT 系列、Claude、Gemini 的迭代逻辑无一例外指向「更多参数 + 更多 token」。但 Oliver Hsu 的判断揭示了一个关键拐点:物理 AI 并非 LLM 的子集,而是并行的一条独立技术曲线。物理 AI 的 Scaling 对象是「动作序列」(action sequences)、物理交互数据和环境反馈,而不是文本 token。这意味着数据来源、算力分配和模型架构都需要重新设计,而这种重构本身就是投资机会的信号。

2. 行业影响:从「辅助工具」到「生产力主轴」

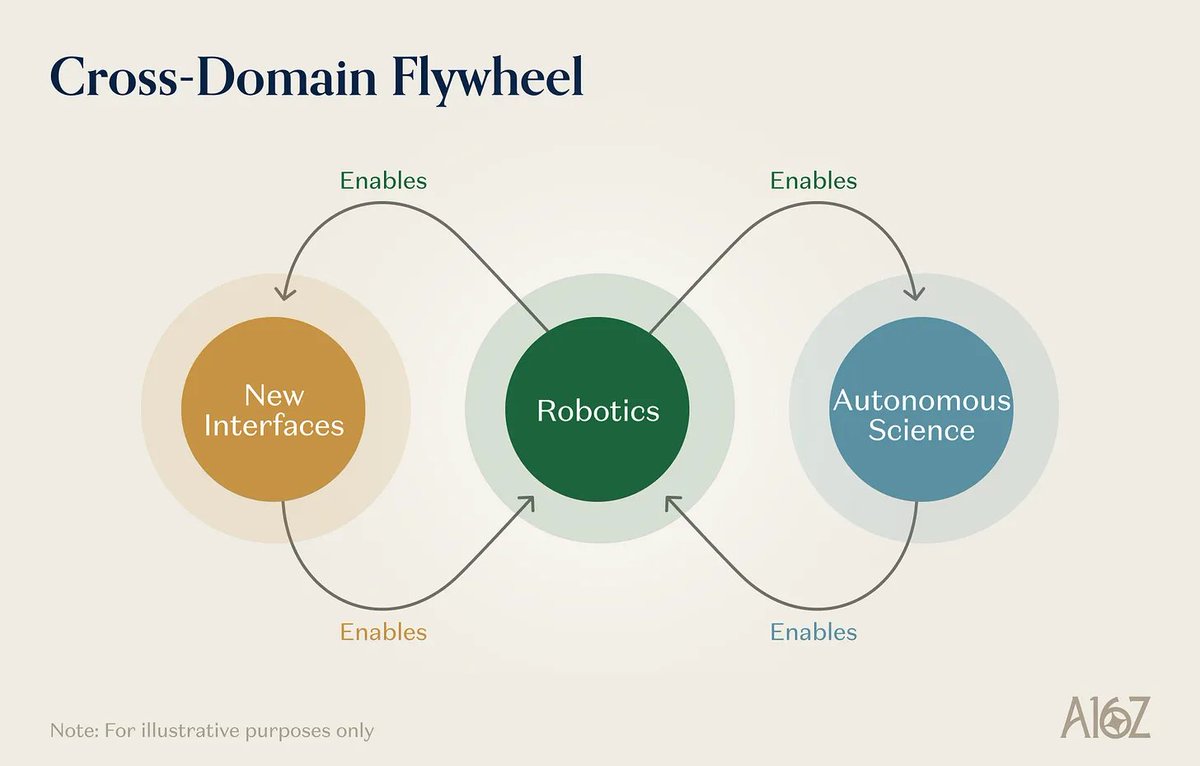

物理 AI 独立 Scaling 的最直接行业影响,是机器人从「预设程序执行者」转变为「通过数据驱动的自主学习者」。Figure AI、1X Technologies、Physical Intelligence(PI)等公司在过去 18 个月里加速积累机器人操作数据,其核心逻辑正是构建物理 AI 版本的「Data Flywheel」——机器人部署越多 → 产生更多真实物理交互数据 → 训练出更通用的操作策略 → 进一步扩大部署规模。如果这一飞轮效应确实成立,物理 AI 的 Scaling 将呈现与 LLM 不同的非线性增长特征。

3. 与其他事件的关联:算力战争的结构性转移

这一判断与近期 NVIDIA 年度 GTC 大会的核心议题高度呼应。NVIDIA 在 GTC 2026 上发布的新一代 Thor 芯片专门针对机器人仿真和具身 AI 训练进行了架构优化,暗示硬件层已经嗅到了物理 AI Scaling 带来的算力需求结构性变化。此外,Figure AI 与 OpenAI 的分道扬镳(Figure 转向自研多模态模型)、Google DeepMind 推出 Robotic Transformer 3(RT-3 的能力跃升),都与 Hsu 的判断构成互证——物理 AI 不是被语言 AI 吞并,而是正在独立成军。

值得关注

- Figure AI 的数据飞轮进展:Figure 近期宣布其机器人已在真实家庭环境中完成超过 10 万次任务交互,需追踪该数据是否驱动了操作成功率的核心指标提升(如从 60% 提升至 80%+),这将是物理 AI Scaling 是否生效的最直接验证。

- NVIDIA Thor 芯片的物理 AI 适配订单量:GTC 2026 上 Thor 的首批客户包括 PI(Physical Intelligence)和 Agility Robotics,订单规模将反映算力层对物理 AI Scaling 的预期强度。

- Physical Intelligence(PI)模型迭代节奏:PI 的 π0 系列模型被视为物理 AI 领域的「GPT-2 时刻」,需关注其下一个版本是否在跨实体(cross-embodiment)泛化能力上实现突破,即同一模型能否控制不同形态机器人。

- Figure 与 OpenAI 合作终止后的独立模型路线:Figure 放弃使用 OpenAI 的语言大模型转而自研,暗示在物理 AI 场景下,语言大模型并不能直接提供核心价值——这一点若被 Figure 的产品验证,将是对 a16z 判断的有力背书。

- 基础科学 AI 领域的物理 AI 应用案例:Oliver Hsu 提到「自主科学研究」(autonomous science),DeepMind 的 AlphaFold 路线正在向自动化实验闭环延伸,需追踪 GNoTIS、Synthesia 等平台在蛋白质工程或材料发现中是否形成物理 AI Scaling 的第三极。

信源行:原文链接:https://x.com/a16z/status/2044467723464523878

背景报道:

• a16z 官网基础设施投资组合分析(Oliver Hsu 代表 a16z 基础设施团队,系统阐述物理 AI 投资逻辑)

• The Robot Report — "Figure AI surpasses 100k real-world robot tasks: inside the Physical AI data flywheel"(2026 年 4 月,对 Figure 数据飞轮的独立验证报道)

• VentureBeat AI — "Why Physical AI is not a subset of LLMs: the architectural argument for separate scaling laws"(2026 年初,对物理 AI 与语言 AI 架构差异的行业分析)