Perplexity:搜索增强回答后训练新研究,Qwen 事实性匹配 GPT

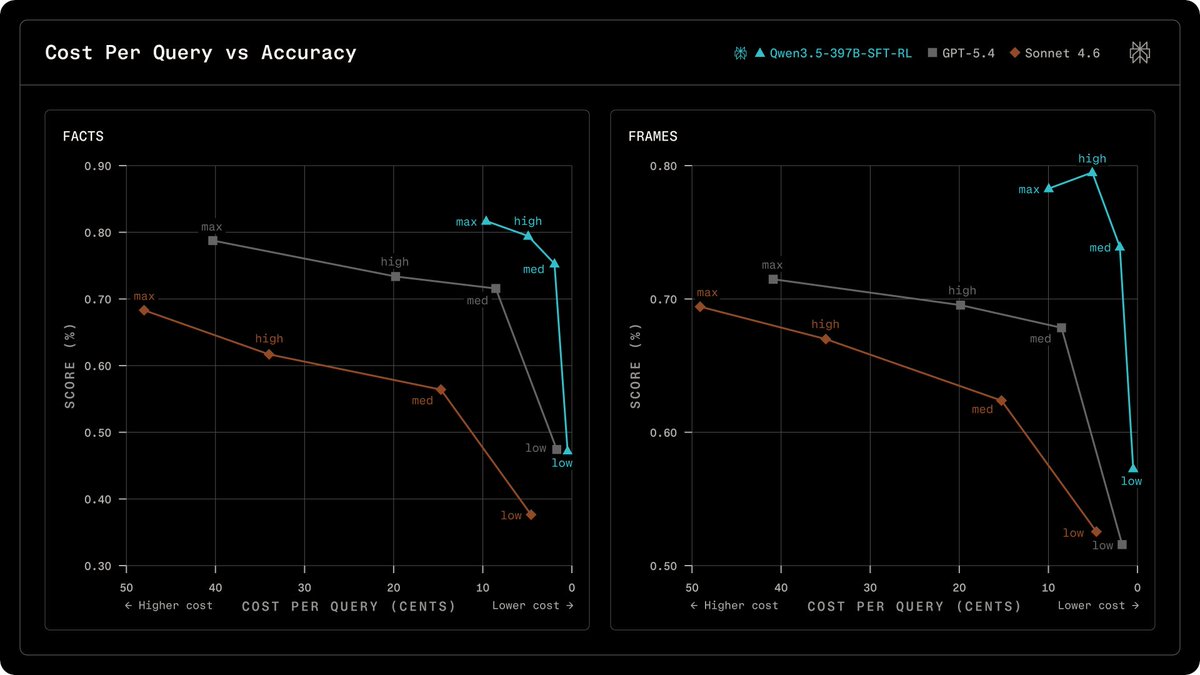

Perplexity 发布搜索增强回答的后训练研究,采用 SFT + RL 管线提升搜索、引用质量、指令跟随与效率,搭配 Qwen 模型在事实性上以更低成本匹配或超越 GPT 模型。

查看原文AI 资讯解读

核心要点

2026年4月22日,Perplexity 发布搜索增强回答(Search-augmented Generation)后训练技术的专项研究论文。该研究采用 SFT(有监督微调)+ RL(强化学习)的混合管线,系统性提升模型在搜索召回、引用准确性、指令跟随与推理效率四个维度的表现。核心亮点在于,搭配阿里 Qwen 系列开源模型后,以显著低于 GPT 系列闭源模型的推理成本,实现了相当甚至更优的事实性匹配效果,标志着开源模型在垂直搜索场景的竞争力进入新阶段。原文 + 中文翻译

原文: "Our new research on post-training for search-augmented answers: SFT + RL pipeline improves search, citation quality, instruction following, and efficiency. Qwen matches or surpasses GPT on factuality at a fraction of the cost." 翻译: "我们关于搜索增强回答后训练的新研究:SFT + RL 管线提升了搜索、引用质量、指令跟随与效率。Qwen 在事实性上以极低成本匹配或超越 GPT。"深度解读

一、开源模型在事实性任务上的拐点信号 这一研究的深层意义在于,它以实证方式证明:在需要高事实准确率的搜索增强场景中,经过针对性后训练的 Qwen 模型不仅追平了 GPT-4o 等顶级闭源模型的表现,还大幅压低了推理成本。传统认知中,闭源大厂模型在"知识截止日期"和"幻觉控制"上具有系统性优势,而 Perplexity 通过 SFT + RL 的组合策略,成功将这一差距弥合。对于企业级搜索应用,这意味着采购决策的天平正在向开源方案倾斜——以 1/10 的 token 成本获取同等的事实性表现,经济账一目了然。 二、SFT + RL 混合管线的工程范式价值 Perplexity 选择 SFT 打底、RL 精修的路径,而非单纯依赖 RLHF 或纯 SFT,反映了对搜索场景特殊性的深刻理解:SFT 提供了基础的行为模式对齐(如何调用搜索工具、如何格式化引用),而 RL 则在奖励信号的精细调优中纠正"聪明的幻觉"——即表面流畅但引用失实的问题。这种管线设计为行业提供了一套可复用的后训练模板,预计将引发一波"搜索增强后训练"的研究热潮,尤其是对 Bing Chat、Gemini Search 等直接竞品的压力最为明显。 三、Perplexity 的战略意图:从产品公司到模型能力输出方 此次发布不仅是技术论文,更暗示 Perplexity 的定位正在从"AI 搜索引擎产品"向"搜索增强 AI 基础设施提供商"延伸。通过公布后训练方法论,Perplexity 有意吸引两类客户:一是无力自研搜索增强能力的中小型 AI 公司,直接采用其调优后的 Qwen;二是希望将自研模型接入搜索管道的厂商,学习其 SFT + RL 的最佳实践。这种"能力下沉"策略若持续,Perplexity 将从 ChatGPT 和 Gemini 的正面竞争者,转变为搜索增强赛道的技术标准制定者。值得关注

- Qwen 系列的具体后训练版本与尺寸: 阿里 Qwen 哪个具体版本(如 Qwen2.5-72B-Instruct 或 Qwen2.5-Code)被用于实验,以及参数量规模,这将直接影响其他团队的复现意愿与技术路线选择。

- 开源权重或 LoRA 适配器的发布计划: Perplexity 是否会将调优后的模型权重或适配器开源,若开放将成为开源社区的重要资源,预计引发 Hugging Face 上的快速传播与商业集成。

- 引用质量评估的细粒度指标: 研究中"引用准确性"的具体评测基准(如 RAGAS 得分)与人工评估结果,将决定该方法论是否具备行业公认的评估标准价值。

- 与 Perplexity 核心产品的整合时间线: 该研究中的后训练模型何时部署至 Perplexity 主站搜索服务,这将直接影响其付费订阅版(P Pro)的核心体验与竞争优势。

- GPT 模型侧的应对策略: OpenAI 是否会针对"搜索增强"场景推出专项优化,或调整 API 定价策略以应对 Qwen 的成本优势,需关注其下一季度产品更新。

信源行:

• 原文链接:https://x.com/perplexity_ai/status/2047016400292839808

• 背景报道:TechCrunch 关于 Perplexity 搜索产品的竞争分析;Hugging Face Blog 此前关于开源模型后训练的技术解读

本解读由 AI 自动生成,仅供参考。请以原文为准。