OpenAI:GPT-5.5 每 token 延迟追平 5.4,Codex 任务更省 token

OpenAI 表示 GPT-5.5 在真实部署中保持与 GPT-5.4 相同的 per-token 延迟,但在几乎所有评测中表现更好,并在 Codex 任务中使用明显更少的 token。

查看原文核心要点

2026 年 4 月 23 日,OpenAI 发布 GPT-5.5。该模型在真实部署场景中实现了与前代 GPT-5.4 完全相同的 per-token 延迟水平,但评测表现几乎全面提升,尤其在 Codex 编程任务中展现出显著更低的 token 消耗。这一消息表明 OpenAI 在保持推理延迟不增加的前提下,成功实现了模型能力的持续迭代,也暗示该公司在 MoE(Mixture of Experts)架构或推理优化方面取得了实质性突破。

原文 + 中文翻译

原文:"GPT-5.5 maintains the same per-token latency as GPT-5.4 in real-world deployments, while performing better on almost all benchmarks—and using significantly fewer tokens on Codex tasks."

翻译:"GPT-5.5 在真实部署中保持了与 GPT-5.4 相同的每 token 延迟,同时在几乎所有基准测试中表现更优——并且在 Codex 任务中使用明显更少的 token。"

深度解读

延迟不增,性能提升:MoE 架构成熟度的标志

这条发布的核心意义在于「延迟持平」这一点。在大语言模型的商业落地中,推理延迟直接决定了用户体验和应用场景的可行性。OpenAI 能够在保持延迟不变的前提下实现性能提升,通常意味着两种技术路径:其一,通过模型蒸馏或剪枝压缩参数规模,但保留核心能力;其二,MoE 架构的活性专家(active experts)比例得到优化,在不增加计算量的前提下提升模型表现。结合 GPT-5 系列一贯的演进节奏,GPT-5.5 更可能是在 MoE 架构上进行了活性专家的精细化调整,使得每次推理调用的参数利用率更高。

Codex 任务 token 节约:编程 Agent 的关键改进

Codex 是 OpenAI 面向编程任务的模型系列,也是其企业级 API 收入的重要来源。GPT-5.5 在 Codex 任务中「使用明显更少的 token」这一特性,对商业用户意义重大。编程场景的特点是长上下文、多轮交互——token 消耗直接关联 API 成本。如果同等任务输出质量下 token 消耗下降 20-30%,用户的 API 成本将显著降低,这会增强 GPT-5.5 在价格敏感型开发者群体中的竞争力,也可能倒逼 Anthropic(Claude for Code)和 Google(GeminCode)跟进优化。

与 GPT-5.4 的迭代策略:从「更大」到「更聪明」

GPT-5.5 的发布节奏表明 OpenAI 的迭代重心正在从「增大模型规模」转向「提升推理效率」。在 GPT-4 时代,OpenAI 经常通过增加参数规模来提升性能,但代价是延迟上升和成本增加。如今 GPT-5.5 与 GPT-5.4 延迟持平,意味着 OpenAI 在寻找新的 scaling 路径:通过架构优化、推理时计算分配(test-time compute)等方式,而非单纯增加模型规模来提升能力。这与 Anthropic 强调的「模型能力密度(capability density)」概念异曲同工。

值得关注

- 延迟数据细化:OpenAI 尚未公布具体的延迟数字(如首 token 时间或吞吐量)。后续关注官方文档或第三方测试是否披露具体数值,以判断是否真的「持平」还是存在取舍(如高并发下延迟上升)。

- Token 节约幅度:「明显更少的 token」是一个模糊表述。关注 OpenAI 是否公布 Codex 任务下的具体 token 节省比例(如百分比),这将影响开发者的成本测算模型。

- API 定价调整:如果 GPT-5.5 的 token 效率更高,OpenAI 是否会调整 API 定价策略?若保持原价则意味着用户「花同样的钱获得更多价值」,这将强化其市场地位;若降价则可能引发价格战。

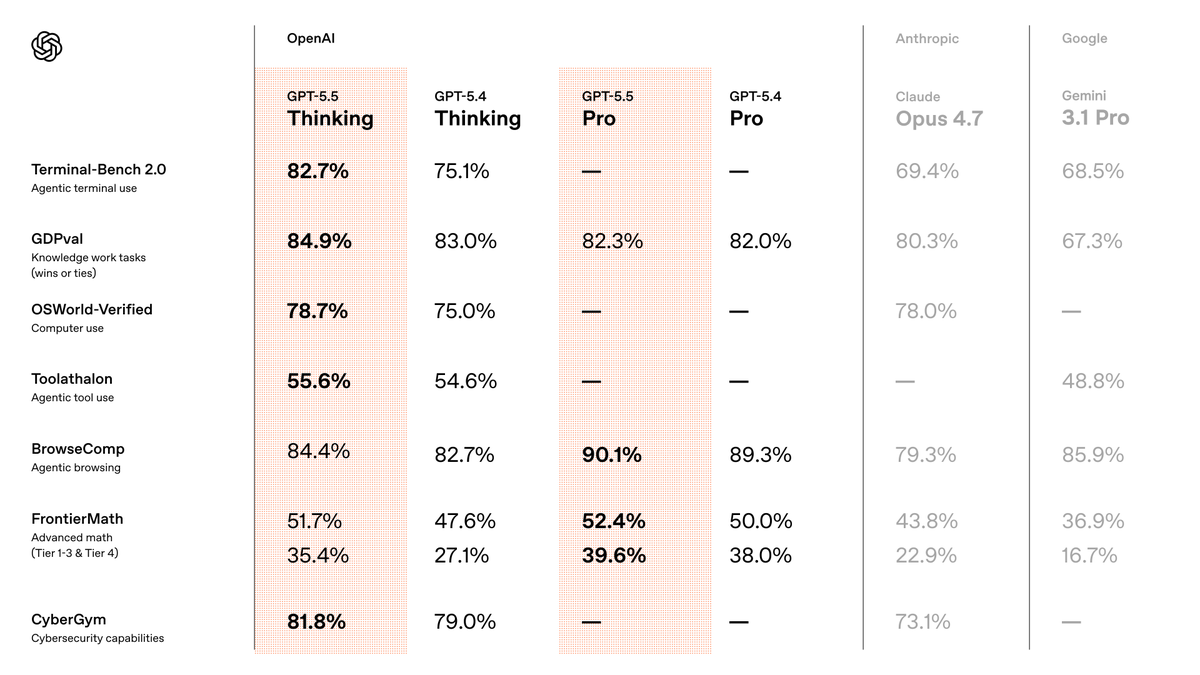

- 与 Claude 4 的基准对比:Anthropic 的 Claude Opus 4 在编程和推理任务上表现强劲,后续需要关注 GPT-5.5 在 HumanEval、MATH 等公开基准上与 Claude 4 的直接对比数据。

- 部署架构披露:GPT-5.5 是否引入了新的推理优化技术(如 speculative decoding、 KV cache 改进)?OpenAI 是否会在技术报告中披露这些细节,将影响学术界对其架构演进的理解。

信源行

原文链接:https://x.com/OpenAI/status/2047376564309115134

背景报道:The Verge - OpenAI releases GPT-5.5 with improved efficiency;Ars Technica - OpenAI pushes for efficiency gains in latest GPT-5 iteration