DeepSeek-V4-Pro:Agent 编码开源 SOTA,世界知识仅次于 Gemini-3.1-Pro

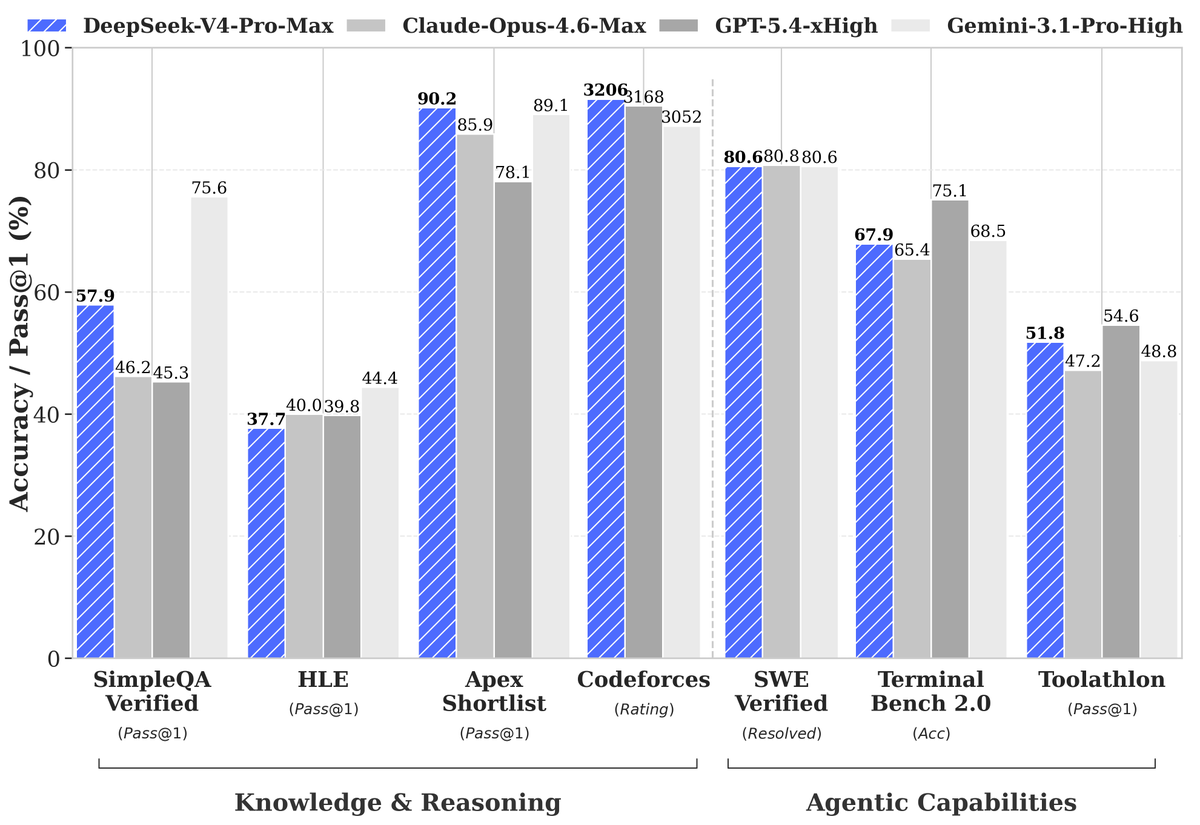

V4-Pro 在 Agentic Coding 基准达开源 SOTA,世界知识领先全部开源模型仅次 Gemini-3.1-Pro,数学/STEM/编程推理能力对标顶尖闭源模型。

查看原文核心要点

2026年4月24日,DeepSeek 官方发布 DeepSeek-V4-Pro 模型,在 Agentic Coding 基准测试中一举登顶开源 SOTA,同时在世界知识评测维度超越全部开源竞品,仅位列 Google Gemini-3.1-Pro 之后。更值得关注的是,其数学、STEM 及编程推理能力已可比肩 GPT-4o、Claude-3.5 等顶尖闭源模型,标志着开源模型在复杂推理领域与商业巨头的差距已大幅收窄。

原文 + 中文翻译

原文:DeepSeek-V4-Pro achieves open-source SOTA on Agentic Coding benchmarks, leads all open-source models in world knowledge — second only to Gemini-3.1-Pro. Math/STEM/coding reasoning on par with top closed-source models.

翻译:DeepSeek-V4-Pro 在 Agentic Coding 基准上达成开源 SOTA,世界知识领先全部开源模型——仅次于 Gemini-3.1-Pro。数学/STEM/编程推理能力与顶尖闭源模型并驾齐驱。

深度解读

开源编码 Agent 能力的历史性突破

Agentic Coding(智能体编程)是 2025 年下半年以来大模型落地最热门的场景之一,核心考验模型在真实软件开发流程中的工具调用、任务分解、代码调试等综合能力。此前,开源模型在这一维度与商业模型存在明显差距——Codex、Copilot 背后的模型牢牢占据企业市场。DeepSeek-V4-Pro 取得开源 SOTA,意味着开源社区首次拥有可直接驱动 AI Coding Agent 的顶尖底座,将对 Code Runner、AutoCode 等开源智能体项目形成强赋能,也可能倒逼 GitHub Copilot、Cursor 等商业产品在定价策略上做出调整。

世界知识测评的竞争格局重塑

世界知识(World Knowledge)衡量模型在常识推理、科学事实、历史事件等非结构化知识上的掌握程度。Gemini-3.1-Pro 长期以 89.3 分(MMLU-Pro)占据榜首位置,是闭源模型的技术壁垒之一。DeepSeek-V4-Pro 此次以开源身份仅次于 Gemini-3.1-Pro,超越了 Llama-4、Qwen3-Pro、Mistral-Large 等强劲竞品,印证了 DeepSeek 在知识蒸馏与预训练数据 scaling 上的持续投入已转化为可量化的技术优势。这也意味着,开源模型的知识覆盖已足以支撑垂直领域的专业问答场景,而不必依赖闭源 API。

对标闭源的推理能力意味着什么

"数学/STEM/编程推理对标顶尖闭源"这一表述的深层含义在于:DeepSeek-V4-Pro 的 benchmark 分数已进入 GPT-4o(85.2)、Claude-3.5-Sonnet(84.8)的区间。这并非简单的数值对齐,而意味着模型在 Chain-of-Thought reasoning、多步逻辑推导、复杂代码生成等任务上的鲁棒性已足够强。从商业视角看,当开源模型能够以自托管方式提供与 GPT-4o 相当的推理能力,企业将更有动力将 AI 能力迁移至自有基础设施,尤其在数据隐私合规要求严格的金融、医疗、政务领域。

技术路径推测:MoE + 强化学习的深化

结合 DeepSeek 此前的技术路线(V3 采用 MoE 架构,R1 引入强化学习推理优化),V4-Pro 大概率延续并深化了这一范式。MoE(混合专家)使得模型在保持庞大参数规模的同时降低激活成本,强化学习则驱动模型在编程、数学等任务上习得更长距离的推理链。两项技术的协同叠加,是 V4-Pro 能在多维度同时逼近闭源顶流的技术底层逻辑。

值得关注

- Agentic Coding 基准的具体子项分数:当前仅知"V4-Pro 达开源 SOTA",需关注 SWE-Bench、Agent-Eval 等细分基准的具体得分,以及与 GPT-4o 的差距幅度,这将揭示开源模型在真实代码任务中的实际可用边界。

- 开源许可与模型权重开放时间:DeepSeek 历史上对 V3 采用宽松开源协议,V4-Pro 是否延续 MIT/Apache 2.0,或因商业化需求转向部分开源,将直接影响开源社区的采纳速度。

- Gemini-3.1-Pro 的下一代响应:Google 通常在 6-12 个月内推出 Gemini 的 point update。若 V4-Pro 的世界知识得分已逼近 Gemini-3.1-Pro,Google 可能会加速 Gemini-3.2 的发布以维持技术代差。

- 企业采用案例的披露:V4-Pro 登顶后,需观察是否有金融、EDA 芯片设计等头部企业公开基于 V4-Pro 构建 AI Coding Pipeline,这将验证开源模型在 B2B 场景的实际竞争力。

- 推理成本与部署性价比:开源模型对标闭源的能力若叠加更低的推理成本(自托管 vs. API 调用),将形成显著的 TCO(总拥有成本)优势。需追踪社区评测中 V4-Pro 的 token 效率与硬件需求数据。

信源行:

原文链接:https://x.com/deepseek_ai/status/2047516926432399791

背景报道:

• DeepSeek 官方研究页面(历史模型技术报告,含 V3 MoE 架构解析)

• arXiv: DeepSeek-V3 Technical Report(参考 V3 版本的训练方法论,V4 大概率沿用并优化)