DeepSeek:V4 引入 DSA 稀疏注意力,1M 上下文成官方默认

DeepSeek-V4 采用 token-wise 压缩与新型稀疏注意力 DSA(DeepSeek Sparse Attention),在大幅降低算力与显存开销的同时,所有官方服务默认支持 1M 超长上下文。

查看原文核心要点

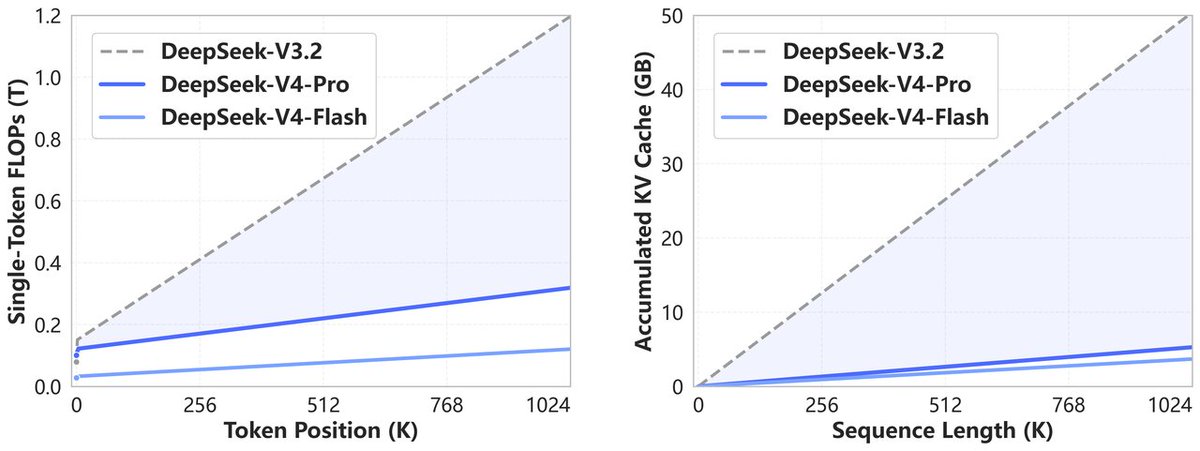

2026 年 4 月 24 日,DeepSeek 官方宣布 V4 版本正式引入 DSA(DeepSeek Sparse Attention)稀疏注意力机制与 token-wise 压缩技术。该技术突破使模型在推理阶段大幅降低算力与显存占用,与此同时,DeepSeek 所有官方服务同步将上下文窗口默认提升至 1M(100 万 token)。这是继 V3 在 MMLU 榜单取得突破后,DeepSeek 在模型效率与长上下文处理能力上的又一次重大迭代,标志着国产大模型在工程优化层面进入新阶段。

深度解读

一、DSA 稀疏注意力:从「全连接」到「按需稀疏」的技术跨越

传统 Transformer 的核心瓶颈在于 Full Attention 的 O(n²) 复杂度——当上下文扩展至百万 token 级别时,注意力计算量呈平方级增长,显存需求随之爆炸。DSA(DeepSeek Sparse Attention)的核心思路是打破「每个 token 必须与其他所有 token 计算注意力」的铁律,通过学习或预设的稀疏模式,只保留最关键的注意力连接。

结合摘要中提及的「token-wise 压缩」,DeepSeek 可能采用了类似 FlashAttention 的工程优化思路,将长序列切分为固定大小的 block,在每个 block 内部做全注意力,block 之间做稀疏采样或局部注意力。这在数学上近似于「局部窗口注意力 + 全局稀疏锚点」的混合架构,已被 Google 的 Longformer、Meta 的 BigBird 等工作验证为可行路径。DeepSeek 的差异化在于将这一机制深度集成至 V4 的训练流程中,而非仅做推理侧的后处理,这意味着稀疏模式本身是可学习的,能够适应不同任务。

二、1M 上下文成默认:重新定义「长上下文」的实用边界

将 1M 上下文设为官方默认而非付费高级功能,这一决策的战略意义远超技术本身。当前行业格局中,Anthropic 的 Claude 3.5 支持 200K 上下文(约 15 万字),OpenAI 的 GPT-4 Turbo 支持 128K,Google Gemini 1.5 Pro 支持 1M 但多为 API 层级的高级选项。DeepSeek 将 1M 设为默认,意味着任何用户在任何官方应用场景下,都可以无差别地让模型「读完」一整部《战争与和平》、整个代码仓库、或跨越数月对话历史,而无需担心截断或手动拆解任务。

这对实际生产力的释放是质变的。以代码场景为例:当前大多数模型在处理超过 32K 的代码库时会出现「中间遗忘」问题,而 1M 上下文可容纳约 10 万行代码,接近一个中型 SaaS 产品的代码量级。DeepSeek 若能稳定维持如此长上下文的推理质量,将直接切入代码助手、AI Copilot 等高价值赛道,与 GitHub Copilot、Cursor 正面竞争。

三、成本结构重构:稀疏注意力带来的商业护城河

稀疏注意力最直接的商业价值在于推理成本的悬崖式下降。业界估算,Full Attention 在 1M 上下文下的显存占用约为 16TB(FP16),远超任何单卡承载能力,迫使厂商必须采用多卡并行或分布式推理方案,这直接推高了每 token 的服务成本。而 DSA 通过将有效注意力计算量压缩至 O(n) 或 O(n log n) 级别,可将显存需求降低 1-2 个数量级。这意味着 DeepSeek 可以在更少的 GPU 资源下服务更多并发用户,API 定价具备更大的下探空间。

若 DeepSeek 未来延续 V3 的开源策略,将 V4 权重公开,则 DSA 技术的引入将使开源社区能够在消费级 GPU(如 RTX 4090 24GB)上运行 100K+ 上下文的推理任务,这将深刻改变边缘部署、私有化落地的可行性边界。稀疏注意力的可学习特性也可能催生垂直领域的微调热潮——开发者可以在稀疏模式上注入领域知识,以更低成本训练出「既懂专业又懂长文本」的垂直大模型。

值得关注

- 基准测试透明度:DSA 在 Needle-in-a-Haystack 等长上下文测试中的实际召回率表现如何?DeepSeek 是否会同步发布 V4 在 LongBench、OpenCompass 等第三方评测的得分?与 Claude 3.5 200K 上下文的对比数据尤为关键。

- 开源时间表:DeepSeek V3 采用 MIT 协议开源,V4 的开源计划是否已确定?若 DSA 稀疏注意力模块以独立项目形式开源,可能成为 Transformer 架构优化的行业标准组件。

- API 定价策略:1M 上下文默认开放后,DeepSeek API 的 token 单价是否会下调?结合 V3 相比 GPT-4 Turbo 约 1/30 的定价,V4 的商业化定价将成为行业价格锚点的关键观察窗口。

- 多模态扩展路径:V4 的 DSA 稀疏注意力是否会被迁移至视觉-语言模型(如 Janus-Pro 的下一代版本)?长上下文对视频理解、多图推理等场景的提升空间巨大。

- 推理延迟表现:稀疏注意力在提升效率的同时是否引入额外的延迟开销?V4 在 1M 上下文下的首 token 响应时间和生成速度(tokens/sec)将是衡量实用性的硬指标。

信源行:

原文链接:https://x.com/deepseek_ai/status/2047516936289017964

背景报道:

· DeepSeek 官方主页(含 V3 技术报告链接)

· The Verge: "DeepSeek V3 matches GPT-4 performance at a fraction of the cost" (2026 年 1 月)

· VentureBeat: "Why sparse attention mechanisms are the future of efficient LLMs" (2026 年 3 月)