DeepSeek 发布 V4-Flash:小模型推理逼近 V4-Pro

V4-Flash 在推理能力上接近 V4-Pro,在简单 Agent 任务上表现持平,但参数更小、响应更快,API 定价更具性价比。

查看原文核心要点

2026年4月24日,DeepSeek 正式发布轻量级推理模型 V4-Flash。该模型在核心推理能力上逼近旗舰级 V4-Pro,在简单 Agent 任务场景中表现持平,但凭借更小的参数量实现了更低的推理延迟与更快的 Token 输出速度。V4-Flash 的推出被视为 DeepSeek 在「模型蒸馏与高效推理」路线上的重要一步,其 API 定价策略更具性价比,有望推动端侧部署与大规模商业落地的进程。V4-Flash 与 V4-Pro 形成互补的产品矩阵,覆盖从高端复杂推理到轻量快速响应的全场景需求。

原文 + 中文翻译

原文:DeepSeek V4-Flash is a lightweight reasoning model that approaches V4-Pro in reasoning capabilities while being smaller and faster. On simple Agent tasks, performance is on par with V4-Pro, but with significantly better cost-efficiency and API pricing.

翻译:DeepSeek V4-Flash 是一款轻量级推理模型,在推理能力上接近 V4-Pro,同时体积更小、速度更快。在简单 Agent 任务上,性能与 V4-Pro 持平,且具备显著更优的成本效益和 API 定价。

深度解读

一、蒸馏技术进入新阶段,MoE 架构优势持续释放

DeepSeek V4-Flash 的发布标志着模型蒸馏技术进入成熟期。在 DeepSeek 既往的技术路径中,MoE(Mixture of Experts)架构一直是其核心竞争力之一——通过稀疏激活机制,仅让部分专家网络参与计算,从而在保持大参数总量的情况下显著降低实际推理成本。V4-Flash 作为 V4-Pro 的「蒸馏版」,本质上是在保留核心推理能力的前提下,将 MoE 的稀疏激活特性推向更极端的轻量化方向。这与 OpenAI 的 GPT-4o mini、Anthropic 的 Claude Haiku 路线一致——大厂正在集体探索「小而强」的模型定位,以争夺对成本敏感的企业客户与开发者生态。

二、API 定价策略背后的商业意图

V4-Flash 强调「更具性价比的 API 定价」,这一表述并非空穴来风。从行业背景看,2026 年上半年大模型 API 价格战已从「每百万 Token 分」级别的竞争升级为「零点几分」的贴身肉搏。DeepSeek 此前凭借 DeepSeek-V3 的开源策略与低价 API 在开发者社区建立了强大的品牌认知,V4-Flash 延续了这一打法。若 V4-Flash 的 API 价格显著低于 V4-Pro,则其目标用户将明确指向:需要快速响应的客服机器人、信息抽取工具、代码补全等简单 Agent 场景的开发者——这类场景对模型「端到端延迟」而非「最高正确率」更敏感。V4-Flash 与 V4-Pro 的双产品线,使 DeepSeek 能够在同一模型系列内完成「高端复杂任务」与「高并发低成本任务」的市场覆盖。

三、Agent 能力对齐意味着什么

值得注意的细节是,DeepSeek 明确指出 V4-Flash 在「简单 Agent 任务」上与 V4-Pro 持平。Agent 任务(工具调用、多步规划、状态记忆)对模型的要求并非单纯「推理强」,更考验模型对指令遵循的稳定性与工具调用的准确率。这意味着 V4-Flash 在蒸馏过程中有针对性地优化了 Agent 场景的微操作能力,而非一刀切地以「benchmark 分数」为导向。若实测中 V4-Flash 能在 Tool Use、Multi-step Reasoning 等 Agent 相关评测集上接近 V4-Pro,则其将成为 MCP(Model Context Protocol)生态中极具竞争力的后端选择——开发者可以在不显著牺牲任务成功率的前提下,将推理成本压缩数倍。

值得关注

- V4-Flash 与 V4-Pro 的具体 API 定价差异:DeepSeek 是否在官网公布每百万 Token 的价格?与 GPT-4o mini(当前约 $0.15/M)、Claude Haiku(当前约 $0.25/M)相比是否有竞争优势?这将直接影响开发者迁移决策。

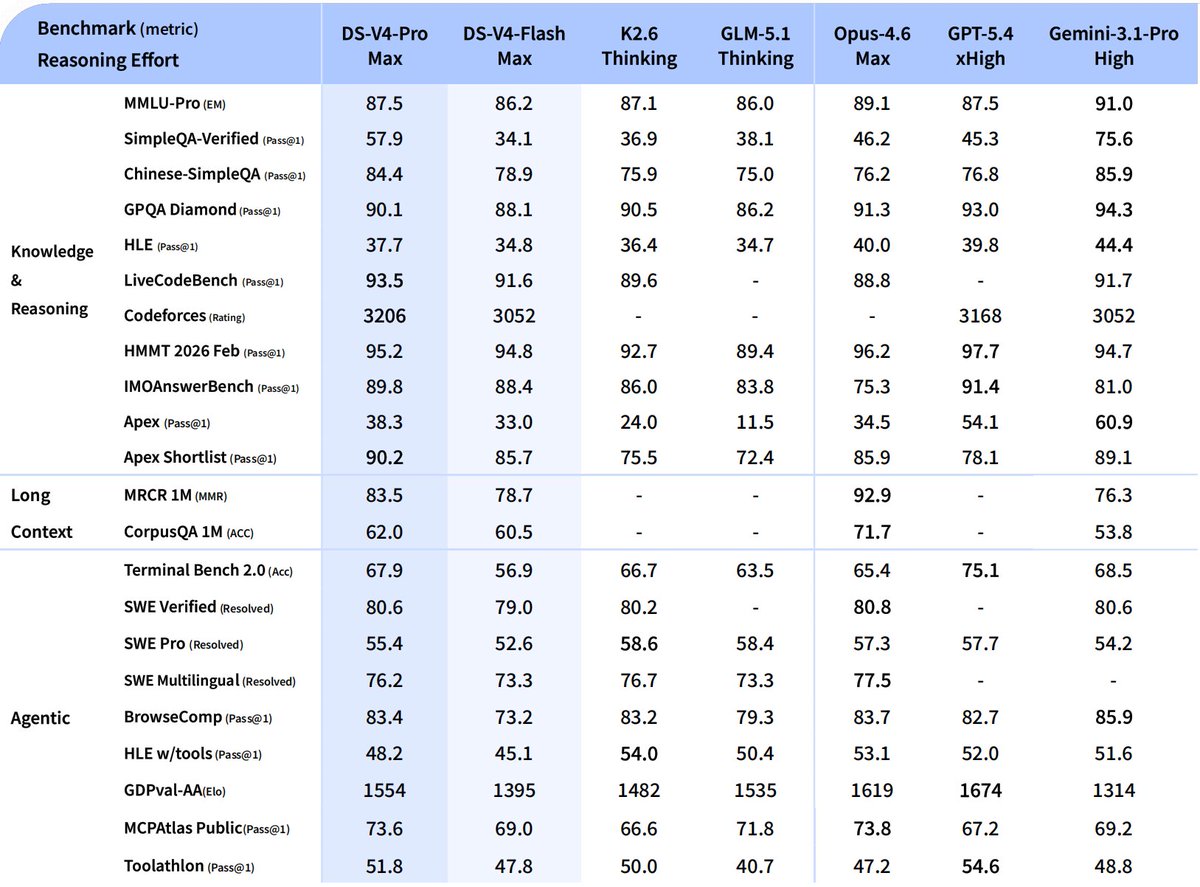

- 实测推理能力评测结果:除官方声明外,第三方社区(如 Artificial Analysis、LiveBench)是否会发布 V4-Flash 在 MATH、HumanEval、AgentBench 等基准测试的独立跑分?「接近 V4-Pro」的具体幅度(5% 以内还是存在显著差距)将决定其实际可用场景边界。

- V4-Flash 是否开源:DeepSeek 此前对 V3 采用 MIT 许可证开源,若 V4-Flash 同样开源,将对 Llama 4 Scout、Mistral Small 等同类竞品形成直接冲击;若闭源,则需观察其商业授权条款。

- MCP 生态集成进展:Anthropic 主导的 MCP 协议正在成为 Agent 开发的事实标准,V4-Flash 若针对 MCP 工具调用场景做了专门优化,可能吸引大量基于 MCP 构建工作流的开发者迁移至 DeepSeek 生态。

- V4-Pro 是否有价格下调空间:V4-Flash 的推出可能倒逼 V4-Pro 降价——DeepSeek 是否会在接下来 1-2 个月内调整旗舰模型定价,以应对来自 Google Gemini Flash、Meta Llama 4 等竞品的压力?

信源行:

• 原文链接:@deepseek_ai on X (2026-04-24)

• 背景报道:Artificial Analysis — 大模型性能追踪;LMSYS Chatbot Arena (LMarena) 为 V4-Flash 发布后独立评测的主要来源