DeepSeek:V4 系列 API 即日上线,统一支持 1M 上下文与双模式

V4-Pro 与 V4-Flash 同步开放 API,兼容 OpenAI ChatCompletions 与 Anthropic 接口,均支持 1M 上下文和 Thinking/Non-Thinking 双模式;旧版 deepseek-chat 与 deepseek-reasoner 将于 7 月 24 日完全下线。

查看原文核心要点

2026年4月24日,DeepSeek 正式上线 V4 系列 API,包含 V4-Pro 与 V4-Flash 两个版本。新 API 统一支持 100 万 token 超长上下文,并创新性地引入 Thinking/Non-Thinking 双模式,开发者可灵活切换推理强度。同时,V4 API 全面兼容 OpenAI ChatCompletions 与 Anthropic 消息格式,大幅降低迁移成本。值得注意的是,旧版 deepseek-chat 与 deepseek-reasoner 接口将于 7 月 24 日完全下线,意味着 DeepSeek 在一年内完成三轮以上重大版本迭代。

原文 + 中文翻译

原文:

"V4-Pro & V4-Flash APIs are now live — both support 1M context, Thinking/Non-Thinking modes, and are compatible with OpenAI ChatCompletions & Anthropic APIs. Legacy deepseek-chat and deepseek-reasoner endpoints sunset on July 24."翻译:

"V4-Pro 和 V4-Flash API 现已上线——两者均支持 100 万上下文、思维/非思维模式,并兼容 OpenAI ChatCompletions 与 Anthropic API。旧版 deepseek-chat 和 deepseek-reasoner 端点将于 7 月 24 日停用。"

深度解读

1M 上下文:长文本处理进入"无感"时代

统一 100 万 token 上下文窗口是本次发布最具技术冲击力的特性。此前,业界虽有个别模型宣称支持超长上下文,但往往存在"长上下文降智"问题——输入文本超过某阈值后,模型输出质量显著下滑。DeepSeek V4 若能保证 1M 上下文的稳定表现,意味着开发者可一次性喂入整部《战争与和平》、完整代码仓库或数百页医学文献,无需依赖繁琐的检索增强生成(RAG)架构。这一能力将直接冲击当前估值数十亿美元的 RAG 赛道,同时为法律合同分析、代码库审计、长篇内容生成等场景打开新的产品想象空间。

双模式设计:效率与深度的动态平衡

Thinking/Non-Thinking 双模式是本次发布中最具产品哲学的设计决策。Thinking 模式对应 Chain-of-Thought 推理,适用于复杂数学证明、多步代码调试、战略分析等需要"慢思考"的场景;Non-Thinking 模式则跳过显式推理链,以更低延迟和成本处理简单问答、文本格式化、批量分类等高频轻量任务。这一设计本质上是将推理强度选择权交给开发者,使同一 API 可以覆盖从"快问快答"到"深度求解"的全谱系需求。对比 OpenAI 的 GPT-4o 与 Claude 3.5,DeepSeek 率先在产品层实现推理模式的显式解耦,这可能成为未来大模型 API 的标准范式。

接口兼容性:争夺开发者迁移的红利窗口

同时兼容 OpenAI 与 Anthropic 接口格式,是一次精准的生态卡位。当前企业 AI 应用普遍基于 OpenAI SDK 构建,切换成本主要来自代码重构。DeepSeek 此举将迁移成本压缩至"改两行配置"的量级——只需将 base URL 指向 DeepSeek 端点,保留原有的 function calling、system prompt、JSON response 格式。这对于正在评估成本优化的中小型 AI 应用团队极具吸引力。考虑到 DeepSeek 一贯的低价策略(V3 时期 API 价格约为 GPT-4 的 1/20),V4 有望在价格敏感型开发者中形成虹吸效应,加速从 OpenAI 生态的份额转移。

版本迭代节奏:DeepSeek 的"快速迭代"护城河

从 2025 年底的 V3,到 2026 年初的 R1,再到此刻的 V4,DeepSeek 在不到半年内完成三轮重大版本迭代。这种发布节奏在头部模型厂商中前所未有——OpenAI、Anthropic 通常保持 12-18 个月的版本周期。快速迭代背后是幻方量化在算力资源与算法人才上的持续投入,也构成了独特的竞争壁垒:竞品尚未完成对 V3 的追赶,V4 已进入生产环境。这种"版本代差"策略正在重塑大模型市场的竞争规则。

值得关注

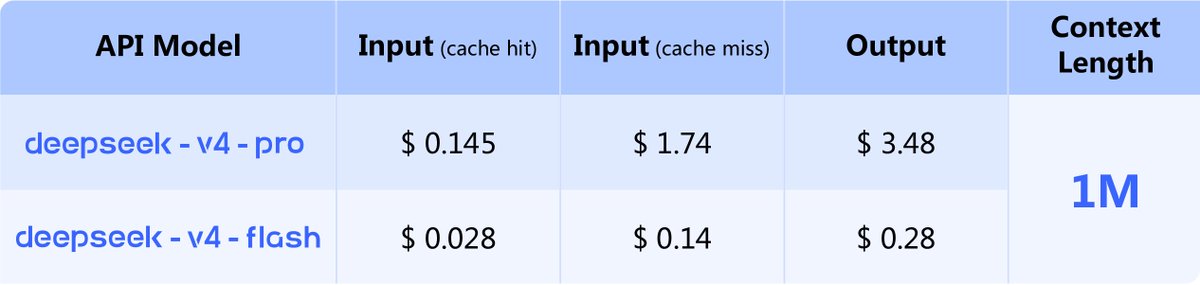

- V4-Pro vs V4-Flash 的性能与定价梯度:两者在 1M 上下文与双模式上的差异尚待披露,需观察 V4-Flash 是否在长文本场景存在 tokens 限制或速率限制,这直接影响开发者选型。

- Thinking 模式的推理成本结构:V3 时期的 deepseek-reasoner 已按输出 tokens 计费且单价较高,V4 的双模式是否会分别定价?Thinking 模式是否会引入"思考 token"的独立计费?需关注官方定价页更新。

- 7 月 24 日旧版下线的时间窗口影响:距今约 3 个月,留给依赖 deepseek-chat / deepseek-reasoner 的开发者迁移时间较为充裕,但企业级客户的合规审计流程可能需要更长时间,需跟踪是否有企业客户的特殊延期政策。

- 竞品的跟进策略:OpenAI 是否会在 GPT-5 或 GPT-4o 更新中引入类似的"双模式"产品设计?Anthropic 是否会为 Claude 开放超长上下文 API?这些决策将在未来 2-3 个月内逐渐清晰。

- V4 的 benchmark 表现与开源时间表:DeepSeek 传统上会同步开源模型权重(如 V3),需关注 V4 是否遵循这一惯例,以及在 MMLU、HumanEval、MATH 等标准测试集上的对标表现。

信源行:

原文链接:@deepseek_ai (X/Twitter)

背景报道:Anthropic API Documentation(Anthropic 接口规范参考);OpenAI API Reference(ChatCompletions 格式说明)