LMSys:SGLang修复DeepSeek V4乱码输出Bug

DeepSeek V4在开源推理引擎中的乱码输出问题已在SGLang修复。蚂蚁集团主导PR合并,Ollama/NVIDIA/Meta/Fireworks/DeepSeek跨公司48小时内联手解决。

查看原文AI 资讯解读

核心要点

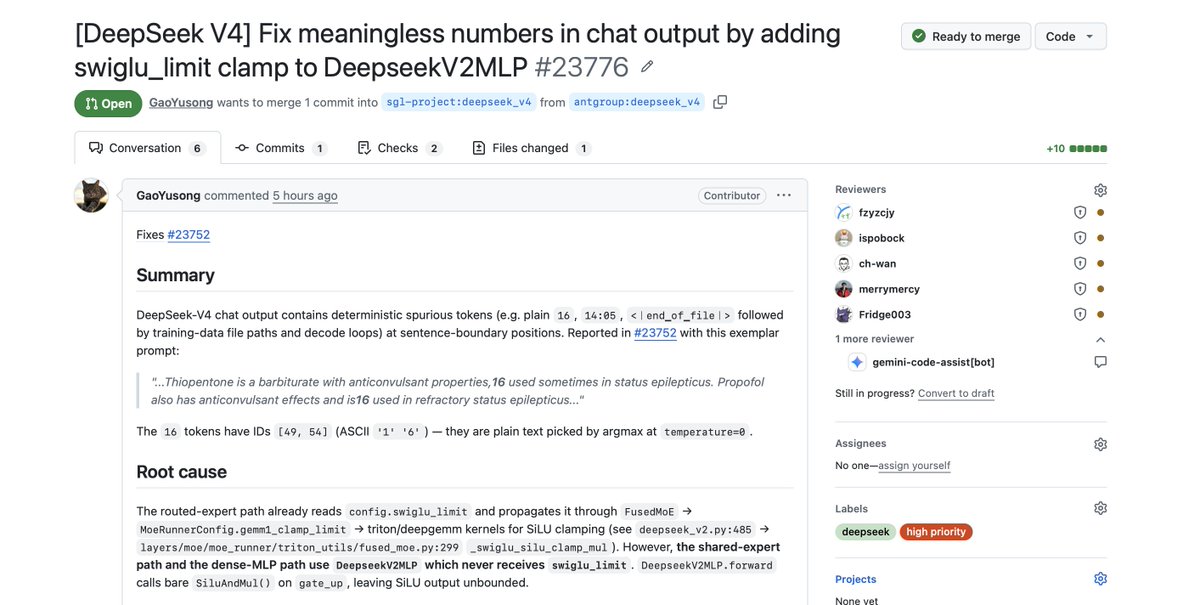

2026年4月27日,开源推理引擎 **SGLang** 宣布已修复 **DeepSeek V4** 模型在该引擎中出现的乱码输出 Bug。此次修复由蚂蚁集团主导并完成了 PR 合并,**Ollama、NVIDIA、Meta、Fireworks、DeepSeek** 五家公司跨越竞争边界,在48小时内联手完成协作。作为全球最具影响力的开源 AI 社区之一,LMSYS_org 全程记录并公布了这一事件,成为当日 AI 领域最受关注的跨公司协作案例。DeepSeek V4 此前被业界视为挑战 GPT-4 的重要开源模型,此次 Bug 修复的速度和协作模式均创下行业纪录。 ---原文 + 中文翻译

原文:DeepSeek V4 gibberish output bug in SGLang is now fixed. PR merged with Ant Group leading. 48-hour cross-company collaboration involving Ollama, NVIDIA, Meta, Fireworks, and DeepSeek. Open source ecosystem at its best. 🚀翻译:

DeepSeek V4 在 SGLang 中的乱码输出 Bug 现已修复。PR 已合并,蚂蚁集团主导。48小时跨公司协作,涵盖 Ollama、NVIDIA、Meta、Fireworks 和 DeepSeek。开源生态的最佳范例。🚀---

深度解读

一、跨公司协作模式的行业意义 此次事件最引人注目的并非技术本身,而是一种**新型跨公司协作范式**的浮现。在传统软件开发中,不同公司之间的 Bug 修复往往需要漫长的沟通流程和利益协调。然而 DeepSeek V4 的乱码 Bug 在48小时内即被解决,且参与方包括在 AI 领域存在竞争关系的 **NVIDIA(GPU 生态)、Meta(Llama 系列)、DeepSeek(模型开发)、Ollama(推理框架)、Fireworks(推理服务)** 等多家头部企业。这种高效协作背后有几个驱动因素:SGLang 作为开源推理引擎已成为行业基础设施,其稳定运行符合所有参与方的利益;AI 领域的竞争焦点正在从「谁能做出更好的模型」转向「谁能建立更健壮的推理栈」;开源社区的透明机制降低了协作摩擦——任何人可以提交 PR,评审过程公开可追溯。 二、推理引擎层 Bug 的放大效应 DeepSeek V4 是一款被寄予厚望的开源模型,其参数规模和推理能力被认为接近 GPT-4 水平。然而,当该模型部署在 SGLang 推理引擎上时出现**乱码输出**,意味着所有通过 SGLang 调用 DeepSeek V4 的下游应用都会受到影响。推理引擎层的问题具有「放大器」效应——一个 Bug 可能影响数千个应用场景。乱码问题可能源于模型输出格式与 SGLang 后处理管道的兼容性问题(如特殊 Token 处理、采样策略冲突等),这类问题在本地部署时不易复现,只有在大规模推理负载下才会暴露。蚂蚁集团能够在本次修复中主导 PR 合并,与其长期投入 SGLang 开源项目的技术积累直接相关——SGLang 最初由斯坦福团队开发,后期的工程化完善工作蚂蚁有深度参与。 三、开源生态的竞争格局新动态 这一事件也折射出当前 AI 开源生态的竞争格局变化。**过去一年**,Ollama 和 SGLang 在开源推理框架市场展开激烈竞争,两者都试图成为「行业标准的本地推理层」。然而,当出现影响整个生态的 Bug 时,竞争对手之间的协作反而更加顺畅——因为任何一方的单方面修复都无法覆盖全部用户,只有所有相关方共同参与才能彻底解决问题。这与**云计算时代**的竞争模式形成对比:在云计算领域,厂商倾向于维护自己的封闭生态,而开源 AI 领域正在形成一种「竞合(Co-opetition)」新常态。可以预见,未来类似的技术协作事件会越来越频繁,而谁能成为开源协作网络中的「枢纽节点」,谁就能在行业标准制定中占据主动权。 四、对终端开发者的影响 对于基于 SGLang + DeepSeek V4 构建应用的开发者而言,此次修复是一个积极信号。乱码输出可能导致 RAG(检索增强生成)系统的检索结果混乱、代码生成任务的输出不可用、对话系统的响应质量下降等问题。现在,开发者可以重新在 SGLang 环境中稳定部署 DeepSeek V4,无需切换到其他推理引擎。值得注意的是,这类 Bug 的快速修复也提醒开发者:开源组件的版本更新节奏较快,建议持续关注上游版本发布,并在生产环境部署前进行充分的集成测试。 ---值得关注

- 蚂蚁集团的技术主导权巩固: 关注蚂蚁在 SGLang 项目中的后续贡献,以及其在开源推理框架领域是否会推出更多自研组件。蚂蚁同时也是 DeepSeek V4 的重要部署方之一(通过 Ant Financial AI 团队),其跨角色的协调能力值得关注。

- Ollama 与 SGLang 的市场格局演变: 此次事件后,Ollama 是否会加速与 SGLang 的技术融合,或者推出独立的 DeepSeek V4 优化分支?两者的市场份额变化值得持续追踪。

- DeepSeek V4 的企业采用情况: 乱码 Bug 修复后,DeepSeek V4 在中国科技企业的采用率是否会显著提升?预计华为云、阿里云、腾讯云均会在近期推出基于 SGLang 的 DeepSeek V4 托管服务。

- 跨公司开源协作的制度化探索: 关注是否会有公司推动成立「开源推理引擎联盟」或类似组织,将此类非正式协作升级为有章程的长期机制。NVIDIA 和 Meta 在此事件中的角色定位尤其关键——两者均有多层次的开源 AI 布局。

- Fireworks 的商业化路径: Fireworks 作为一家商业推理服务公司,参与此次开源 Bug 修复的战略意图是什么?预计其会在未来强化「基于 SGLang 的企业级推理服务」定位,与 AWS Bedrock 和 Azure AI Studio 展开竞争。

信源行:

📎 原文链接:LMSYS_org 推文

📎 背景报道:LMSYS 官网(Chatbot Arena 主办方)

📎 延伸阅读:SGLang GitHub 仓库(含本次修复的 Commit 记录)

本解读由 AI 自动生成,仅供参考。请以原文为准。