vLLM:Day-0 支持英伟达 Nemotron 3 Nano Omni 多模态混合 MoE 模型

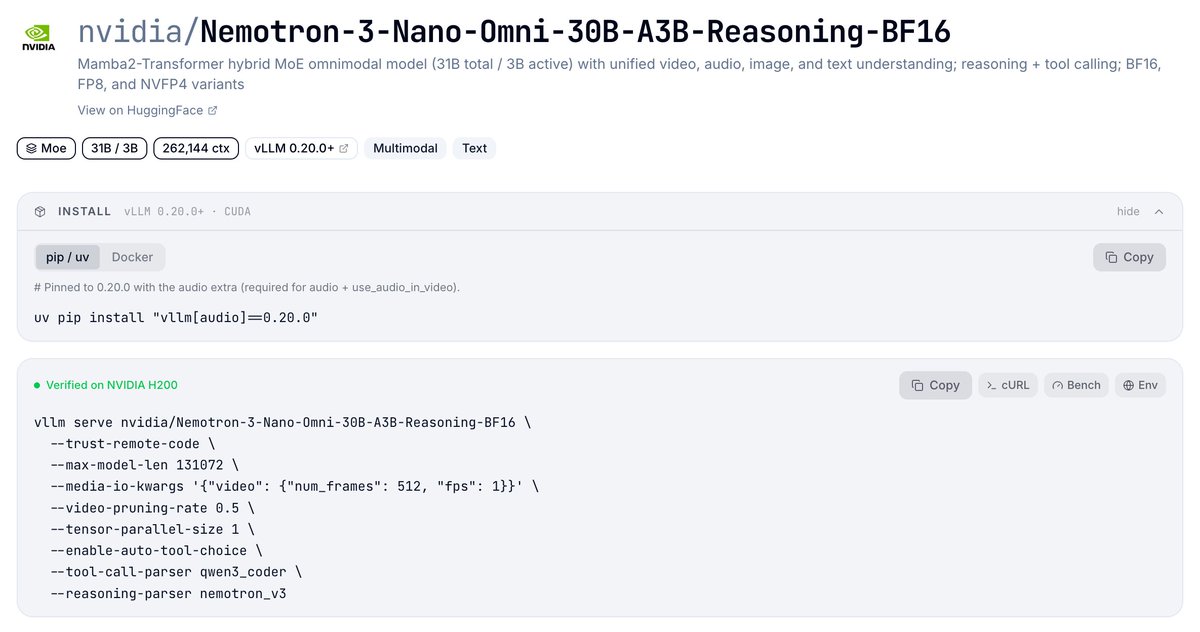

vLLM 宣布对 NVIDIA Nemotron 3 Nano Omni 提供 Day-0 支持。该模型为 30B 参数 Transformer-Mamba 混合 MoE(3B 激活),统一视觉/音频/视频/文本,256K 上下文,支持 FP8 与 NVFP4 量化。

查看原文AI 资讯解读

核心要点

vLLM 在模型发布当日即实现对 NVIDIA Nemotron 3 Nano Omni 的支持。该模型采用Transformer-Mamba 混合架构结合 MoE 设计,仅用 3B 激活参数驱动 30B 总参数量,支持视觉/音频/视频/文本四模态统一,并提供 256K 超长上下文与 FP8/NVFP4 低比特量化能力。

深度解读

这条资讯看似是一条常规的框架支持公告,实则折射出当前 LLM 领域几个关键趋势的交汇点。

首先是架构创新的实用性落地。Transformer-Mamba 混合设计并非新概念,但 NVIDIA 将其推向生产级部署,证明了这种"选择性状态空间"的混合路线已在工业界获得认可。MoE 的稀疏激活特性(30B 参数仅 3B 激活)使得单卡部署 30B 模型成为可能,这对边缘和 enterprise 场景意义重大。

其次是多模态大一统趋势加速。从 GPT-4V 的视觉单模态,到 Gemini 的视觉+音频,再到现在四模态原生融合,模型正在向"全感知"演进。vLLM 的 Day-0 支持表明开源推理框架的响应速度已与模型发布节奏同步,这对于需要快速验证的开发者社区是利好。

量化技术的代际更迭同样值得关注。FP8 已是主流,而 NVFP4(NVIDIA FP4)作为 Blackwell 架构的新特性,暗示了硬件-软件协同优化的新阶段。

值得关注

- 实际推理性能基准:3B 激活参数在消费级 GPU(如 RTX 4090)上的吞吐与延迟表现,以及与同级别 Dense 模型的对比

- Mamba 组件的调度效率:混合架构在长序列场景下的状态管理开销,以及是否出现" Hybrid 幻觉"问题

- 多模态融合的精度权衡:NVFP4 量化对音频/视频模态的影响是否显著,是否需要针对不同模态采用差异化量化策略

本解读由 AI 自动生成,仅供参考。请以原文为准。