vLLM:Day-0 支持蚂蚁 Ling-2.6-flash MoE 模型

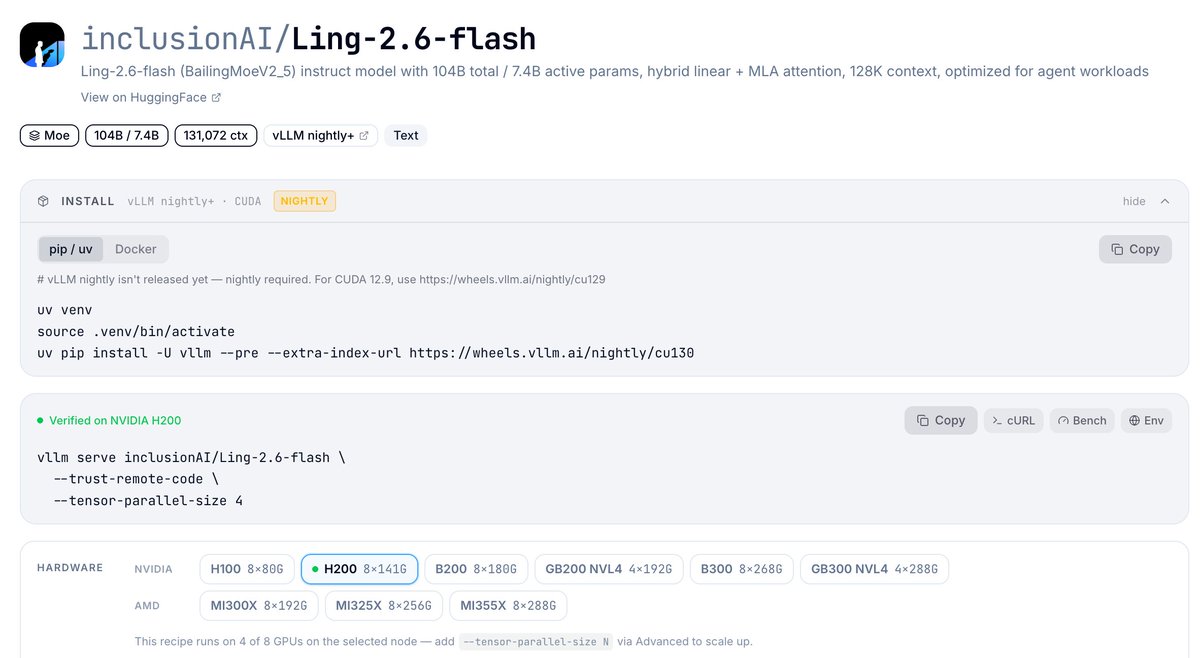

蚂蚁集团 Ling-2.6-flash 即时 MoE 模型上线即获 vLLM Day-0 支持。104B 总参/7.4B 激活,混合 1:7 MLA+Lightning Linear 注意力,262K 上下文,原生工具调用。

查看原文核心要点

vLLM 在蚂蚁 Ling-2.6-flash 模型发布当日即提供原生支持,展现了开源推理框架与头部模型厂商的协作效率。该模型为 104B 总参/7.4B 激活的稀疏 MoE 架构,采用创新的 1:7 MLA 与 Lightning Linear 混合注意力设计,并支持 262K 长上下文与原生工具调用能力。

深度解读

vLLM 实现「Day-0」支持的意义远超表面——这意味着蚂蚁在模型设计阶段就与 vLLM 团队保持密切沟通,而非事后适配。在大模型落地成本压力下,MoE 架构通过稀疏激活显著降低推理成本:7.4B 激活参数对比 104B 总参,理论上可将单次推理的计算量压缩至传统dense模型的 7% 左右。

值得关注的是其混合注意力机制设计。MLA(Multi-head Latent Attention)源自 DeepSeek 系列,通过低秩压缩降低 KV 缓存开销;Lightning Linear 注意力则针对长序列优化计算效率。两者混合 1:7 的配比,暗示模型在短对话场景偏好 Lightning Linear 高速推理,在复杂推理任务中切换至 MLA 获取更好的上下文建模能力。

262K 上下文窗口配合原生工具调用,使该模型具备处理复杂长文档分析、多轮 Agent 任务的能力。结合蚂蚁集团的金融业务场景,这一组合可支撑客服对话摘要、合同条款解析、多步骤风控查询等高价值企业级应用。从行业格局看,此举进一步强化了 vLLM 作为企业级推理首选框架的地位,也反映出国内大模型厂商正从「自建推理栈」向「依托开源生态」转型的趋势。

值得关注

- 性能基准对比:Ling-2.6-flash 在 vLLM 上的吞吐量与延迟表现如何?与传统 dense 模型(如 Qwen-72B)及同类 MoE 模型(如 DeepSeek-V2)的推理效率差异值得关注

- Lightning Linear 注意力机制:该机制的具体实现与适用场景边界,其对长序列任务的实际加速效果需进一步观察

- 企业落地案例:蚂蚁是否会将其作为内部推理标准?其他金融科技企业是否会跟进采用该组合方案